FastSAM, ağır Transformer (ViT) modelleri ile ilişkili önemli hesaplama kaynak gereksinimlerini ele almak için doğdu. hafif CNN modelinin gücünden yararlanarak, FastSAM, kullanıcı etkileşimli istemleri rehberliğinde bir görüntüdeki herhangi bir nesneyi segmentleyebilen, SAM’dan daha etkili bir yöntem haline gelir; tüm bunları gerçek zamanlı ve çok daha hızlı bir şekilde gerçekleştirir!

SAM ve Ötesi

Geleneksel veri seti etiketleme ve toplama yöntemleri ile karşılaştırıldığında, veri seti değiştiğinde modeli yeniden eğitmek için çok fazla kaynak ve zaman gerektiren yöntemler, SAM, bir görüntüden neredeyse her şeyi kesebilen tamamen otomatik bir yönlendirilmiş görüntü segmentasyon modeli olarak öne çıkmaktadır. 11 milyon görüntü ve 1.1 milyar segmentasyon maskesi üzerinde eğitilen SAM, belirli nesneler için noktalar/metin istemleri temelinde maskeler oluşturma veya alma yeteneğine sahiptir.

FastSAM bunun ötesine geçer. Görevi bir örnek segmentasyon görevine dönüştürerek, yalnızca 1/50’sini kullanarak Meta AI tarafından yayınlanan SA-1B veri seti, nihayetinde 50 kat daha hızlı çalışma süreleri elde ederken SAM ile karşılaştırılabilir bir doğruluk sağlar.

FastSAM için İki Aşama

FastSAM’ı iki aşamaya ayırın: Tüm örnek Segmentasyonu (AIS) ve İstem rehberliğinde Seçim (PGS). İlk aşama, bir görüntüdeki tüm nesneleri veya bölgeleri segmentlemenin temel yöntemidir ve ikinci aşama, belirli bir ilgi nesnesini tanımlamaya yardımcı olan görev odaklı bir son işlem aşamasıdır.

TÜM örnek Segmentasyonu

İlk aşama, görüntüdeki tüm örneklerin segmentasyon maskelerini üretmek için YOLOv8-seg kullanır.

YOLOv8’in omurga ağı ve boyun modülü, YOLOv5’in C3 modülünü C2f modülü ile değiştirir. Güncellenmiş Baş modülü, sınıflandırma ve tespit başlarını ayıran bir yapı benimser ve Anchor-Based’den Anchor-Free’ye geçiş yapar.

YOLOv8-seg, örnek segmentasyonu için YOLACT ilkelerini uygular. Bir görüntüden özellik çıkarımı ile başlar ve çeşitli boyutlardaki özellikleri entegre eden bir Özellik Piramidi Ağı (FPN) kullanır. Çıktı, tespit ve segmentasyon dallarını içerir.

İstem rehberliğinde Seçim

İkinci aşamada, isteme karşılık gelen ilgi alanı çıktısını verir. İşte üç yöntem:

- Nokta istemleri:

- İstem olarak ön plan/arrière plan noktalarını kullanın

- Bir ön plan noktasının birden fazla maskede yer alabileceği hatalarını önlemek için, arka plan noktaları, göreve ilgili maskeleri tanımlamak için kullanılabilir

- İlgi alanındaki birden fazla maskeyi tek bir maske içinde birleştirerek, ilgi nesnesini tamamen işaretleyin

- Kutu istemleri

- Seçilen kutu ile ilk aşamadaki çeşitli maskelere ait sınırlayıcı kutular arasında Kesişim Birliği (IoU) eşleştirmesi yapın

- Maskenin tanımlanmasında en yüksek IoU puanına sahip ilgi nesnesini seçin

- Metin istemleri

- Her maskeyle eşleşen içsel özellikleri temsil eden ilgili metin gömme değerlerini çıkarmak için CLIP modelini kullanın

- Metin isteminin görüntü gömme değerleri ile en yüksek benzerlik puanına sahip maskeyi seçin

Gerçek Dünyada Uygulama Senaryoları

Anomali Tespiti

Bu genellikle, üretim kalite kontrolü, IoT makineleri/cihazları için öngörücü bakım, hayati sağlık göstergeleri izleme ve video analizinde olağandışı davranış tespiti gibi geniş bir endüstriyel senaryoda örnek kusur tespit görevlerini tamamlamak için kullanılır.

FastSAM, ön plan/arrière plan noktaları/kutu istemi seçimi temelinde tam olarak kusurlu bölgeleri segmentleyebilir, ancak her şeyi maskeleme modunda SAM’a göre daha düşük bir hassasiyet elde edecektir.

Belirgin nesne Segmentasyonu

Bu yöntem, bir görüntü/video içindeki en görsel olarak belirgin ve ilgili nesneleri tanımlamayı ve izole etmeyi amaçlar; psikolojide davranış analizi ve göz izleme çalışmaları, Artırılmış Gerçeklikte etkileşim artırma, tanılamada önemli anatomik yapıların izolasyonu ve güvenlik yönetimi için biyolojik özellik çıkarımı gibi çoklu görsel algı senaryolarını ele alabilir.

FastSAM, nesnenin kenarlarında yalnızca küçük detayların kaybolmasıyla SAM ile benzer bir performans gösterir. Bir diğer sınırlama, FastSAM-kutu isteminin tek bir kutu ile birden fazla nesneyi seçememesidir; hatta SAM-kutu şu anda bunu başarmak mümkün değildir.

Bina Çıkartma

Bu, çeşitli endüstrilere fayda sağlayacak ve kentsel alanların ve altyapının verimli yönetimi ve geliştirilmesine katkıda bulunacaktır. Genellikle, şehir planlaması, navigasyon sistemi iyileştirmesi, ağ kapsama optimizasyonu, toplu taşıma planlaması ve arazi kullanımı/ürün yönetiminde önemli bir rol oynadığını görüyoruz.

FastSAM, diğerlerinden bir binayı tanımlamada harika sonuçlar gösterir, ancak SAM ile karşılaştırıldığında gölgelerle ilgili daha az bölge tespit edilebilir. Ancak, gölge bölgesinde FastSAM-nokta istemi kullanıldığında, orijinal bina nesnesi ile birleştirildiğinde doğru sonuç alır; bu, FastSAM’ın gürültü etkilerine karşı direnç gösterirken harika performans sergilediğini göstermektedir.

FastSAM ile Başlarken

Modeli Python uygulamanıza entegre etmek için Ultralytics’in FastSAM belgelerine göz atın; burada iki seçenek göreceksiniz: resmi FastSAM Github deposu ve bu süreci kolaylaştırmak için Ultralytics Python API.

Size ipuçları! İşte AE Youjiang’dan, NVIDIA Jetson Orin NX ile güçlendirilmiş video girişi ile FastSAM bina çıkarma demosunu göstermek için hızlı bir tur:

- reComputer cihazına Jetpack OS yükleyin

- FastSAM deposunu klonlayın ve CLIP modelini, PyTorch’u ve Torchvision’ı yükleyin

- Youjiang’ın deposunu klonlayarak Inference.video.py dosyasını alın; bu dosya, FastSAM deposu içinde orijinal Inference.py’nin yanına eklenmelidir

- Jetson cihazında çıkarım yapmak için önceden eğitilmiş PyTorch modelini kullanın.

- PyTorch formatında model ağırlıklarını indirin

- Yeni bir Python betiği oluşturun ve aşağıdaki kodu girin. Dosyayı kaydedin ve çalıştırın

from ultralytics import YOLO

model = YOLO('FastSAM-s.pt') # özel olarak eğitilmiş bir modeli yükleyin

# TensorRT FP32 dışa aktarma

# model.export(format='engine', device='0', imgsz=640)

# TensorRT FP16 dışa aktarma

model.export(format='engine', device='0', imgsz=640, half=True)- Artık demoyu çalıştırma zamanı!

#Video için

python3 Inference_video.py --model_path <model yolu> --input_path <giriş videosu yolu> --imgsz 640#Webcam için

python3 Inference_video.py --model_path <model yolu> --input_path <kamera kimliği> --imgsz 640Kendiniz denemek için Youjiang’ın GitHub’ındaki tam adımlara göz atın.

Neden reComputer

reComputer J4011, NVIDIA Jetson Orin NX 8GB modülü ile kenar cihazlarına 70 TOPS’a kadar AI performansı sunar ve USB 3.2 portları (4x), HDMI 2.1, WIFI için M.2 anahtarı E, SSD için M.2 anahtarı M, RTC, CAN, Raspberry Pi GPIO 40-pin ve daha fazlasını içeren zengin bir IO setine sahiptir. Ayrıca, bir alüminyum kasa, bir soğutma fanı ve heatsink ile birlikte gelir ve önceden yüklenmiş JetPack 5.1.1 Sistemi ile donatılmıştır. Video analitiği, nesne tespiti, doğal dil işleme, tıbbi görüntüleme ve robotik alanlarında çalışan kenar AI çözüm sağlayıcıları için mükemmel bir seçimdir.

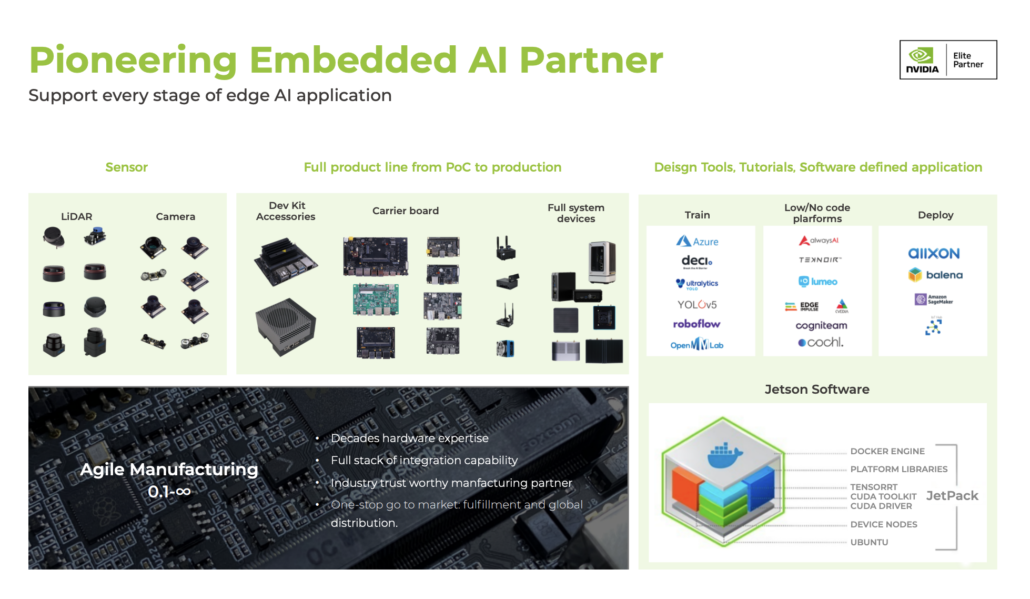

Seeed NVIDIA Jetson Ekosistemi

Seeed, NVIDIA Partner Network‘de kenar AI için bir Elite ortaktır. Daha fazla taşıyıcı kart, tam sistem cihazları, özelleştirme hizmetleri, kullanım senaryoları ve geliştirici araçları keşfetmek için Seeed’in NVIDIA Jetson ekosistemi sayfasını ziyaret edin.

- AI yeniliğinin ön saflarında bizimle birlikte yer alın! Keskin donanım ve teknolojinin gücünü kullanarak makine öğreniminin gerçek dünyada uygulanmasını devrim niteliğinde değiştirin. Geliştiricilere ve işletmelere mevcut en iyi ML çözümlerini sağlama misyonumuzun bir parçası olun.

- İlk adımı atın ve bu heyecan verici yolculuğun bir parçası olmak için bize edgeai@seeed.cc adresine bir e-posta gönderin! Sektörünüzde doğru çözümü bulmak için en son başarı hikayelerimizi keşfedin!

- Size uygun bir seçenek bulmak için en son Jetson Kataloğumuzu indirin. İhtiyaçlarınıza uygun hazır Jetson donanım çözümünü bulamazsanız, lütfen özelleştirme hizmetlerimizi kontrol edin ve değerlendirme için yeni bir ürün sorgusu göndermek üzere odm@seeed.cc adresine başvurun.

Referans

- Fast Segment Anything makalesi, Xu Zhao, Wenchao Ding, Yongqi An, Yinglong Du, Tao Yu, Min Li, Ming Tang ve Jinqiao Wang’dan: https://arxiv.org/pdf/2306.12156.pdf

- Segment Anything Model (SAM) nedir? Bir Analiz, Jacob Solawetz’ten: https://blog.roboflow.com/segment-anything-breakdown/

- Makale İncelemesi: Fast Segment Anything, Andrew Lukyanenko’dan: https://artgor.medium.com/paper-review-fast-segment-anything-912d198557ca