Bir bilgisayar kümesi, bir grup bilgisayarın (veya düğümün) tek bir hesaplama varlığı olarak birlikte çalıştığı bir grup olarak tanımlanır. Aslında, dünyanın en geniş hesaplama yeteneklerinden bazıları küme hesaplama aracılığıyla elde edilmektedir. Peki, bir GPU kümesi nedir – ve bir edge GPU kümesini bu kadar benzersiz kılan nedir? Bu makalede, bir edge GPU kümesinin edge computing uygulamalarınızı nasıl geliştirebileceğini öğrenmek için bize katılın!

Bu makalede aşağıdaki içerikler ve daha fazlası ele alınmaktadır:

- Kümeleme nedir & Edge’de Kümeleme?

- GPU Kümelemeleri neden benzersizdir?

- GPU kümeleri neden kullanılır?

- GPU Kümelemeleri için Uygulamalar & Kullanım Senaryoları

- Bir GPU Kümesi Oluşturma – Bileşenler & Donanım

- Öğretici: Jetson Mate ile bir Kubernetes Edge GPU Jetson Kümesi Oluşturun

Edge GPU Kümelemeye Giriş

Edge GPU kümeleri, edge computing amaçları için GPU’lar (veya Grafik İşlemcileri) taşıyan edge üzerinde dağıtılan bilgisayar kümeleridir. Edge computing, uygulamalarının yerel alanında fiziksel olarak bulunan cihazlarda gerçekleştirilen hesaplama görevlerini tanımlar. Bu, bu süreçlerin uzaktan yönetildiği bulut bilişimle tezat oluşturur.

Özünde, hem edge hem de bulut bilişim aynı şeyleri yapmayı amaçlar – verileri işlemek, algoritmaları çalıştırmak vb. Ancak, edge ve bulut bilişim arasındaki temel fark, hesaplamanın gerçekten nerede yapıldığıdır.

Yaygın edge cihazlarına bazı örnekler arasında cep telefonları, akıllı saatler ve hatta otonom araçlar bulunmaktadır! Edge computing, gecikmenin azaltılması, maliyetlerin düşürülmesi, veri güvenliğinin artırılması ve sistem güvenilirliği gibi birçok fayda sağlar.

Geleneksel olarak, küme hesaplama bulut bilişimle sınırlıydı, ancak Tek Kartlı Bilgisayarlar (SBC’ler) ve ağ altyapısındaki ilerlemelerle bu artık böyle değil. Örneğin, aşağıda gösterilen Jetson Mate Taşıyıcı Kartı, size dört adede kadar Jetson Nano modülü bağlama imkanı sunarak, 11 x 12 cm’lik son derece kompakt bir alanda kendi bilgisayar kümenizi oluşturmanıza olanak tanır!

Basit terimlerle, Edge’de Küme Hesaplama‘yı, küme hesaplamanın faydalarını edge computing’e getirmeyi amaçlayan yeni bir paradigma olarak anlayabilirsiniz; böylece her iki dünyanın en iyisini elde edersiniz! Ve bir edge GPU kümesinde, bu özellikle birden fazla GPU ile gerçekleştirilir!

Grafik İşlemcileri (GPU’lar) & GPU Kümelemeleri

GPU’lar nedir?

GPU kümelerini anlamak için önce bireysel bir GPU’nun işlevlerini keşfetmemiz gerekiyor. Grafik İşlemcileri, bir tür ASIC (Uygulamaya Özel Entegre Devre) olup, başlangıçta 3D grafiklerin işlenmesini hızlandırmak için tasarlanmıştır. Ancak zamanla, daha fazla programlanabilirlik sayesinde daha fazla alanda etkili hale gelmişlerdir.

CPU’lar ve GPU’lar

GPU’ların yakın akrabası olan CPU’lar (Merkezi İşlem Birimleri) ile tanışmış olabilirsiniz. CPU’lar, düşük gecikme etkileşimi sağlamak amacıyla görevleri hızlı bir şekilde ardışık olarak işlemek için tasarlanmıştır. Örneğin, depolanan medyayı okumak, dosya sistemlerinde gezinmek veya internette dolaşmak genellikle CPU tarafından gerçekleştirilir.

Öte yandan, GPU’lar paralel hesaplama konusunda uzmanlaşmıştır. Karmaşık problemleri çok daha küçük görevlere ayırarak hepsini aynı anda hesaplarlar ve böylece yüksek verimlilikte hesaplama elde ederler. Geleneksel olarak, grafik işleme bu durumdan büyük ölçüde faydalanmıştır, çünkü dokuların, aydınlatmanın ve şekillerin işlenmesi, akıcı hareketli grafikler üretmek için aynı anda yapılmalıdır.

GPU’ların izolasyonda çalışmadığını ve bunun yerine CPU’ları büyük ölçüde tamamladığını anlamak önemlidir. Bu nedenle, tüm modern bilgisayarlar genellikle bir CPU ve bir GPU kombinasyonunda gelir!

GPU’ların Evrimi – GPGPU’lar

GPU’ların grafik işleme dışında kullanımına geçiş, artık GPU’ları grafik işleme ötesinde genel amaçlı iş yüklerini yerine getirmek için programlamamıza olanak tanıyan modern GPU çerçevelerinin sayesinde gerçekleşmiştir. Bu, Genel Amaçlı GPU’nun kısaltması olan GPGPU olarak adlandırılır. Bugüne kadar en popüler iki GPU çerçevesi şunlardır:

1. CUDA (Hesaplama Birleşik Cihaz Mimarisi), NVIDIA’nın özel çerçevesidir,

2. veya OpenCL (Açık Hesaplama Dili), açık kaynaklı bir GPGPU çerçevesidir.

Genel olarak, uygulamanız izin veriyorsa, CUDA, geliştirici topluluğu tarafından daha iyi performans sonuçları nedeniyle tercih edilen çerçevedir. Bunun nedeni, CUDA’yı kullanan uygulama geliştiricileri için NVIDIA’nın mükemmel desteğidir; bu da yazılımınız ile GPU donanımınız arasında sorunsuz bir entegrasyon sağlar. NVIDIA ayrıca, kişisel, kurumsal veya edge computing kullanımı için en üst düzey GPU’lar üretmektedir ve bunların hepsi CUDA ile yerel uyumluluğa sahiptir.

Neden GPU’ları Kümelemek?

GPU kümelemeye karşılık gelen üç tür GPU kümesi vardır. Bunlar şu şekilde özetlenmiştir:

- Yüksek Erişilebilirlik – Bir arıza durumunda istekleri başka bir düğüme yönlendirerek uygulamaların her zaman erişilebilir olmasını sağlar.

- Yük Dengeleme – Yüksek iş hacimlerini yönetmek için hesaplama iş yüklerini köle düğümler arasında eşit bir şekilde dağıtır.

- Yüksek Performans – Yüksek hesaplama gereksinimlerine sahip görevler için hesaplama gücünü artırmak amacıyla birden fazla köle düğüm paralel olarak kullanılır.

Ancak, GPU kümeleri geleneksel CPU-only kümelere kıyasla birçok fayda sağlayabilir. Örneğin, alan, güç ve soğutma taleplerini azaltırken, yönetilmesi gereken işletim sistemi görüntülerinin sayısını da en aza indirirler. Eşsiz paralel hesaplama yetenekleri ile birleştirildiğinde, GPU kümeleme kesinlikle birçok edge computing uygulaması için güçlü bir adaydır.

Edge GPU Küme Kullanımları

Edge GPU kümesinin faydalarından yararlanmak istiyorsunuz, ancak nasıl uygulayacağınızı bilmiyor musunuz? Bugün, edge’de çalışan GPU kümeleri artık nadir bir manzara değil. Aslında, şimdi bunlar vazgeçilmez olarak tanımlanabilir – işte birkaç örnek!

Grafik İşleme

GPU’ların yüksek verimli genel amaçlı hesaplama yapacak şekilde evrildiğinden bahsettik, ancak bu, grafik işleme konusundaki orijinal rollerinin artık geçersiz olduğu anlamına gelmiyor! Fotoğraf, video düzenleme, 3D modelleme, sanal veya artırılmış gerçeklik, GPU’ların geleneksel işlevlerine devam eden birçok modern uygulamadan sadece birkaçıdır. Ne yazık ki, ayrı GPU’larla donatılmış dizüstü bilgisayarlar büyük ve pahalıdır, oysa masaüstü çözümler birçok durumda gereken taşınabilirlikten yoksundur.

Taşınabilir ve uygun fiyatlı bir çözüm için bir kenar GPU kümesi düşünün! Çok daha küçük bir form faktöründe paketlenmiş olmasına rağmen hala önemli miktarda güç sunarak, grafik yoğun iş yüklerini ana bilgisayarınızdan kenar GPU kümesine aktarabilir ve yoğun grafik iş yüklerini daha verimli bir şekilde işleyebilirsiniz.

Görüntü / Video İşleme

Alternatif olarak, GPU’lar büyük miktarda görüntü ve video verisi işlemek için harika kaynaklardır, örneğin gözetim sistemlerinde! Bu, böyle verilerin birden fazla giriş akışından işlenmesi gerektiğinde daha da önemlidir, örneğin bir gözetim sistemindeki birden fazla güvenlik kamerası. Son yıllarda, GPU’lardaki gelişmeler sayesinde donanım hızlandırmalı video işleme, video gözetim uygulamalarını önemli ölçüde dönüştürerek daha yüksek çözünürlükler ve daha hızlı kare hızları sunmuştur.

IoT gözetim sistemlerinde, bir kenar GPU kümesi, sistemin daha yüksek çözünürlüklerde daha fazla kamerayı işleme yeteneklerini önemli ölçüde artırabilir. Bu, sistemin çok daha ölçeklenebilir olmasını sağlar ve uzun vadede donanım veya elektrik maliyetlerinde tasarruf sağlar.

Kenar Üzerinde Makine Öğrenimi

Makine öğrenimi, özellikle sinir ağları / derin öğrenme, gerçekleştirilecek çok sayıda hesaplama nedeniyle önemli miktarda hesaplama gücü gerektirir. Sonuç olarak, veri merkezlerinde barındırılan güçlü GPU’lar, makine öğrenimi iş yüklerinde eşzamanlı hesaplamaları yönetmek için uzun zamandır vazgeçilmez olmuştur.

Ancak günümüzde bu durum artık geçerli değil. Bir kenar GPU kümesi ile, bulut bilişimin bir zamanlar özel olan hesaplama yeteneklerini kenar IoT cihazlarına getirebiliriz ve onları daha akıllı hale getirebiliriz. Makine öğrenimi çıkarımlarını çalıştırma yeteneği ile, kenar cihazları artık tahmin yapma, karmaşık verileri işleme ve hatta çözümler sağlama gibi karmaşık görevleri yerine getirebilir.

Ayrıca, bu Kenar AI dönüşümü, gecikmenin azaltılması, bant genişliği gereksinimlerinin ve maliyetin azaltılması, veri güvenliğinin artırılması ve güvenilirliğin iyileştirilmesi gibi birkaç önemli faydayı da beraberinde getirir. Kenar AI ve dönüşüm etkileri hakkında daha fazla bilgi için önceki makaleme göz atın.

Kubernetes ile Ölçeklenebilir Uygulamalar Dağıtma

Günümüzde, Kubernetes bahsetmeden küme hesaplamasından söz etmek neredeyse imkansızdır; bu, konteynerleştirilmiş iş yüklerini ve hizmetleri yönetmek için açık kaynaklı bir platformdur. Kesinlikle mevcut olan tek çözüm değil, ancak 2021’de bilgisayar kümelerini dağıtmanın en popüler yollarından biridir. Bunu, GPU kümelerinizi en verimli şekilde kullanmak için kaynakları gerektiği gibi artırıp azaltmanıza yardımcı olan bir yönetim arayüzü olarak düşünebilirsiniz!

Kümeleme Gerçekten Nasıl Çalışır?

Bir bilgisayar kümesi, her biri düğüm olarak bilinen birden fazla makineden oluşur. Her kümede genellikle tek bir ana düğüm bulunur ve ardından birden fazla köle düğüm (veya işçi düğüm) gelir. Hepsi yüksek bant genişliği bağlantıları aracılığıyla birbirine bağlıdır ve genellikle aynı işletim sistemini çalıştırır.

Küme bir görev aldığında, örneğin bazı verileri işleme ve geri döndürme isteği, ana düğüm görevleri köle düğümlere devretmekten sorumludur. Hesaplama iş yükünün dağıtım şekli, kümelerin birbirinden farklı olduğu yerin büyük bir kısmıdır. Örneğin, bazı kümeler mümkün olan en yüksek performansı sunmaya odaklanırken, diğerleri arızalara karşı koruma sağlamak üzere tasarlanmıştır.

Bir GPU Kümesi Oluşturma – Bileşenler & Donanım

Seeed’in Kenar GPU Kümeleme Çözümleri

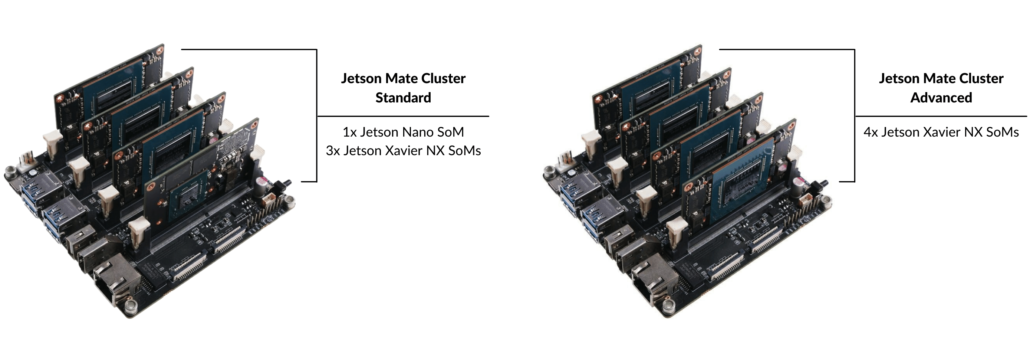

Seeed, Jetson Mate ve NVIDIA’nın Jetson Nano / Xavier NX modülleri ile tam kenar GPU kümeleme çözümünü sunmaktan gurur duyar. Taşıyıcı kart ve Jetson modülleri ile birlikte, kenar uygulamaları için NVIDIA’nın sektör lideri GPU’ları ile güçlendirilmiş tam bir NVIDIA GPU Kümesi elde etmek artık çok kolay!

Artık Seeed’den tam bir kenar GPU kümesi için donanımı iki pratik paket halinde alabilirsiniz:

- Jetson Mate Küme Standart 1 Jetson Nano SoM ve 3 Jetson Xavier NX SoM ile

- Jetson Mate Küme Gelişmiş 4 Jetson Xavier NX SoM ile

Kenar GPU kümelemenin bileşenleri hakkında daha fazla bilgi edinmek için okumaya devam edin, Jetson Mate’i tanıtan!

Donanım #1 – Taşıyıcı Kart

Bir kenar kümesinde, taşıyıcı kart kesinlikle en önemli bileşendir. Sonuçta, bilgisayar düğümlerinizi birbirine bağlayarak bir bilgisayar kümesinin yüksek performans veya yüksek kullanılabilirlik özelliklerini oluşturur! Bu nedenle, kenar kümesinin taşıyıcı kartının aşağıdaki özelliklere sahip olması son derece önemlidir:

1. Ana ve işçi düğümler arasında yüksek hızlı iletişimi kolaylaştırabilmeli

2. Kümenin belirli uygulaması için yeterli G/Ç ve soğutma sağlamalı

“`html

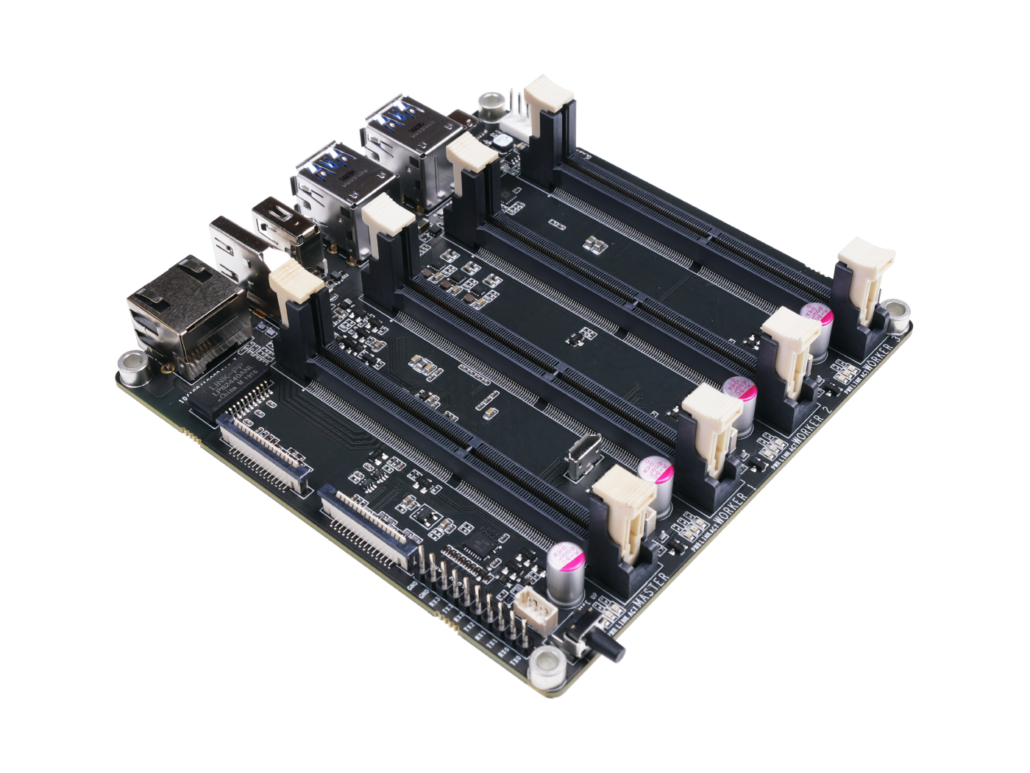

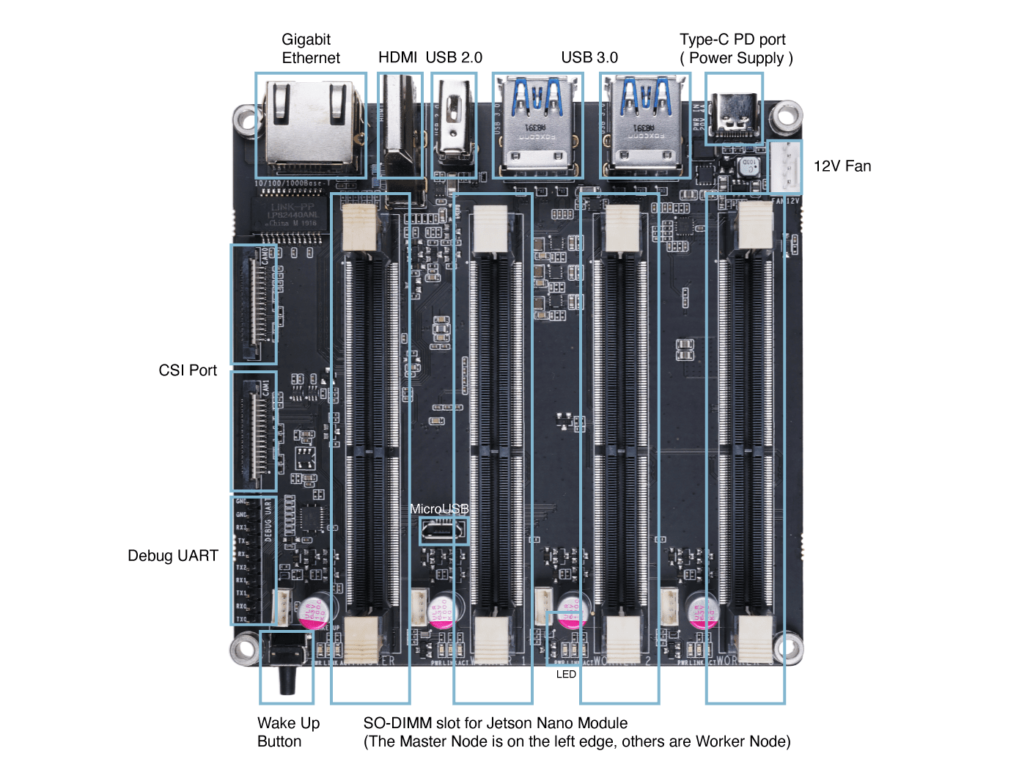

Tam Kümelenme Çözümü: Jetson Mate

Edge GPU kümeniz için bir taşıyıcı kartta kapsamlı ve güvenilir bir çözüm arıyorsanız, Jetson Mate ideal bir seçim olacaktır. Birbirleriyle iletişim kurabilen 4 SoM’a kadar olanak tanıyan 5 portlu gigabit anahtarı ve 3 işçi/uygulama düğümü için bağımsız güç ile donatılmış olan Jetson Mate, zengin çevre birimleri (CSI, HDMI, USB, Ethernet) ve yerleşik fanı ile edge üzerinde GPU kümeleri oluşturmak için eksiksiz bir çözümdür.

Jetson Mate, NVIDIA’nın kendi Jetson Nano / NX SoM’larını kompakt form faktöründe barındırabilir ve edge üzerinde muazzam bir hesaplama gücü sunar. Kolayca kurulabilen bir tasarıma sahip olan Jetson Mate, GPU kümeleriniz için yüksek esneklik ve performans da sunar.

Jetson Mate hakkında daha fazla bilgi edinmek için ürün sayfasını ziyaret etmeyi unutmayın!

Donanım #2 – Bilgisayar Düğümleri

Elbette, dikkatinizi ve bütçenizi yönlendireceğiniz bir sonraki bileşen, hesaplama düğümleri için donanımdır. İdeal olarak, yönetimi kolaylaştırmak ve gerektiğinde düğüm rollerini değiştirme esnekliği sağlamak için tüm modüllerin aynı olmasını istersiniz. İşte Jetson Mate Taşıyıcı Kart ile edge GPU kümenizi oluşturmak için kullanabileceğiniz GPU donanımlı düğümler için iki öneri!

NVIDIA Jetson Nano Modülü

Özellikle NVIDIA’nın JetPack SDK ile AI uygulamaları için tasarlanmış olan Jetson Nano, düşük güç tüketimi ile edge üzerinde güçlü makine öğrenimi uygulamaları oluşturmayı, dağıtmayı ve yönetmeyi kolaylaştırır. 128 NVIDIA CUDA Çekirdeği ile donatılmıştır. Bu, başlangıç seviyesindeki kullanıcılar için mükemmel bir GPU yetenekli modüldür ve kendi IO ve çevre birimleri ile birlikte bir geliştirici kiti form faktöründe de mevcuttur.

Ürün Özellikleri:

- Dört Çekirdekli ARM Cortex-A57 MPCore İşlemci

- 128 NVIDIA CUDA Çekirdeği ile NVIDIA Maxwell GPU

- 1600MHz 25.6GBps hızında 4GB 64-Bit LPDDR4 Bellek

- 16GB eMMC Depolama

- AI Geliştirme için NVIDIA JetPack SDK

Kendi NVIDIA Jetson Nano Modülünüzü Seeed Online Store‘dan edinin!

NVIDIA® Jetson Xavier™ NX Modülü

Jetson Nano’dan biraz daha pahalı olmasına rağmen, Jetson Xavier NX modülü GPU hesaplama gücü konusunda tüm imkanları sunmaktadır. 384 NVIDIA CUDA çekirdeği ve makine öğrenimi için 48 Tensor çekirdeği ile Jetson Xavier NX, FP16 değerleri için 6 TFLOPS (trilyon kayan nokta işlemi) ve INT8 değerleri için 21 TOPS (trilyon işlem) kapasitesine sahiptir. NVIDIA Jetpack SDK ile uyumlu olan Jetson Xavier NX modülü, nihai hedefiniz ne olursa olsun tüm ihtiyaçlarınızı karşılayacaktır.

Ürün Özellikleri:

- Düşük güç tüketimi ile gelişmiş AI uygulamaları için yeterince güçlü kompakt boyut SoM

- Uygulama geliştirme ve optimizasyon için tam NVIDIA Yazılım Yığını desteği

- Jetson TX2’nin performansının 10 katından fazla

- NVIDIA JetPack™ SDK kullanarak AI uygulamalarının geliştirilmesini sağlar

- Edge’de AI’yi kolayca inşa etme, dağıtma ve yönetme imkanı

- Pazar için azaltılmış geliştirme maliyetleri ile esnek ve ölçeklenebilir platform

- Ürün ömrü boyunca sürekli güncellemeler

Kendi NVIDIA Jetson Xavier NX Modülünüzü Seeed Online Store‘dan edinin!

Donanım #3 – Çevre Birimleri

Kümenizin performansının uygun olmayan çevre birimleri tarafından engellenmediğinden emin olmak da önemlidir. Örneğin, modüllerin hızlı SD kartlar kullandığından emin olmalısınız, böylece okuma-yazma darboğazlarından kaçınılır. Öte yandan, uygun bir güç kaynağı kullanmak, bilgisayarlarınızın maksimum potansiyelinde çalışmasını sağlamak için kritik öneme sahiptir. Yetersiz güç sağlamak, sistem arızasına veya en kötü durumda veri bozulmasına ve kaybına yol açabilir.

Öğretici: Jetson Mate ile Kubernetes Edge GPU Jetson Kümesi Oluşturma

Bu bölümde, Jetson Mate ve güçlü Jetson Nano modülleri ile kendi edge GPU kümenizi kurmanın ne kadar kolay olduğunu göstereceğim. Ayrıca, tam öğreticiyi Seeed Wiki sayfamızda okuyabilirsiniz.

Gerekli Malzemeler

Bu öğreticiyi takip etmek için aşağıdaki öğelerin önerildiğini unutmayın. En az iki Jetson Nano modülüne ihtiyacınız olacak, çünkü bir ana / baş düğüm ve bir işçi / köle düğüm için en az birine ihtiyacımız var.

- Jetson Mate Taşıyıcı Kart

- Jetson Nano Modülü (en az 2)

- PD Protokolü ile Nitelikli Type-C Güç Adaptörü (minimum 65W)

Jetson OS’u Kurun ve Yapılandırın

Her bir modül için işletim sistemini NVIDIA’nın resmi SDK yöneticisi ile yapılandırmamız gerekecek.

Öncelikle, aşağıda gösterildiği gibi hedef donanımı seçin.

“““html

Sonra, yüklemek istediğiniz işletim sistemi ve kütüphaneleri seçin:

Dosyaları indirin ve yükleyin. İndirme sırasında, Jetson Nano hesaplama modülünü Jetson Mate’in ana düğümüne yerleştirin.

Bunun ardından, 2 GND pinini gösterilen resme göre kısaltın.

Jetson Mate’i bilgisayarınıza mikro USB portu aracılığıyla bağlayın ve makineyi uyandırma butonuna basarak açın.

Son adım, işletim sistemini hesaplama modülüne yüklemektir. İşletim sistemi ve yazılım kütüphanesi yüklemesi tamamlandığında, bir pencere açılacaktır. Manuel Kurulum seçeneğini seçin, ardından flash’a tıklayın ve tamamlanana kadar bekleyin. Hepsi bu!

Tüm modüllerin yalnızca ana düğümde kurulu olduğunda yüklenebileceğini unutmayın. Tüm modüllerinizi ana düğümde birer birer yükleyip yapılandırmanız gerekmektedir.

Küme üzerinde Kubernetes çalıştırma

Sonraki adımlarda, NVIDIA Jetson Nano modüllerimiz kümesinde Kubernetes’i yükleyip yapılandıracağız!

Docker’ı yapılandırma

Hem Çalışan hem de Ana modüller için, docker çalışma zamanını varsayılan olarak “nvidia” olarak yapılandırmamız gerekiyor.

Aşağıdaki gibi /etc/docker/daemon.json dosyasını değiştirin.

{

"default-runtime" : "nvidia",

"runtimes": {

"nvidia": {

"path": "nvidia-container-runtime",

"runtimeArgs": []

}

}

}Docker daemon’ını aşağıdaki komutla yeniden başlatın,

sudo systemctl daemon-reload && sudo systemctl restart dockersonra Docker varsayılan çalışma zamanını NVIDIA olarak doğrulayın.

sudo docker info | grep -i runtimeİşte örnek bir çıktı:

Runtimes: nvidia runc

Default Runtime: nvidiaKubernetes’i yükleme

Hem Çalışan hem de Ana modüller için, komut satırında aşağıdaki komutlarla kubelet, kubeadm ve kubectl yükleyin.

sudo apt-get update && sudo apt-get install -y apt-transport-https curl

curl -s https://packages.cloud.google.com/apt/doc/apt-key.gpg | sudo apt-key add -

# Kubernetes deposunu ekleyin

cat <<EOF | sudo tee /etc/apt/sources.list.d/kubernetes.list

deb https://apt.kubernetes.io/ kubernetes-xenial main

EOF

sudo apt update && sudo apt install -y kubelet kubeadm kubectl

sudo apt-mark hold kubelet kubeadm kubectlDeğiştirmeyi devre dışı bırakın. Not: Her yeniden başlattığınızda bunu kapatmanız gerekiyor.

sudo swapoff -aAşağıdaki adımlarda kullanacağımız deviceQuery’yi derleyin.

cd /usr/local/cuda/samples/1_Utilities/deviceQuery && sudo makeKubernetes’i yapılandırma

Yalnızca Ana modülde, kümeyi başlatın:

sudo kubeadm init --pod-network-cidr=10.244.0.0/16Çıktı, kümeye bir pod ağı dağıtmak için çalıştırılabilecek komutları ve kümeye katılmak için komutları gösterir. Her şey başarılı olursa, çıktının sonunda buna benzer bir şey görmelisiniz:

Kubernetes kontrol düzleminiz başarıyla başlatıldı!

Kümenizi kullanmaya başlamak için, aşağıdakileri normal bir kullanıcı olarak çalıştırmanız gerekir:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

Artık kümeye bir pod ağı dağıtmalısınız.

Aşağıdaki seçeneklerden biri ile "kubectl apply -f [podnetwork].yaml" çalıştırın:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

Ardından, her birini kök olarak aşağıdaki komutu çalıştırarak herhangi bir sayıda çalışan düğüme katılabilirsiniz:

kubeadm join 192.168.2.114:6443 --token zqqoy7.9oi8dpkfmqkop2p5 \

--discovery-token-ca-cert-hash sha256:71270ea137214422221319c1bdb9ba6d4b76abfa2506753703ed654a90c4982bÇıktıdaki talimatları izleyerek, aşağıdaki komutları çalıştırın:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/configKontrol düzlemi düğümüne bir pod-ağı eklentisi yükleyin. Bu durumda, calico kullanıyoruz.

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.ymlTüm podların çalıştığından emin olun:

kubectl get pods --all-namespacesİşte örnek bir çıktı:

NAMESPACE NAME READY STATUS RESTARTS AGE

kube-system kube-flannel-ds-arm64-gz28t 1/1 Running 0 2m8s

kube-system coredns-5c98db65d4-d4kgh 1/1 Running 0 9m8s

kube-system coredns-5c98db65d4-h6x8m 1/1 Running 0 9m8s

kube-system etcd-#yourhost 1/1 Running 0 8m25s

kube-system kube-apiserver-#yourhost 1/1 Running 0 8m7s

kube-system kube-controller-manager-#yourhost 1/1 Running 0 8m3s

kube-system kube-proxy-6sh42 1/1 Running 0 9m7s

kube-system kube-scheduler-#yourhost 1/1 Running 0 8m26sYalnızca Çalışan modüller üzerinde, artık her düğümü kümeye ekleme zamanı geldi; bu, kube init komutunun sonunda sağlanan kubeadm join komutunu çalıştırmaktan ibarettir. Kümenize eklemek istediğiniz her Jetson Nano için, ana makineye giriş yapın ve şunu çalıştırın:

the cluster - your tokens and ca-cert-hash will vary

$ sudo kubeadm join 192.168.2.114:6443 --token zqqoy7.9oi8dpkfmqkop2p5 \

--discovery-token-ca-cert-hash sha256:71270ea137214422221319c1bdb9ba6d4b76abfa2506753703ed654a90c4982bYalnızca Ana düğümde, aşağıdaki komutu çalıştırdığınızda yeni düğümleri görmelisiniz:

“`

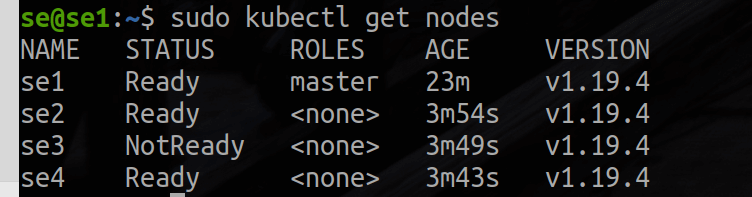

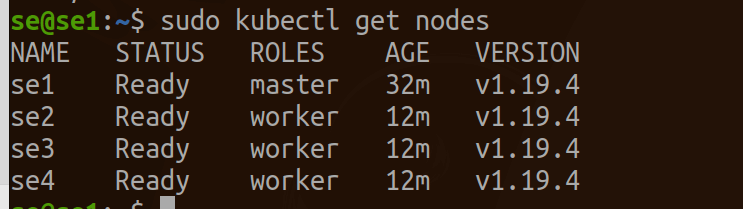

kubectl get nodesİşte üç işçi düğümü için örnek çıktı.

Düğümlerinizi takip etmek için, her işçi düğümünü bir işçi olarak etiketlemek için sahip olduğunuz modül sayısına göre aşağıdaki komutları çalıştırın! Bu örnek üç işçi kullandığı için, şunları çalıştıracağız:

kubectl label node se2 node-role.kubernetes.io/worker=worker

kubectl label node se3 node-role.kubernetes.io/worker=worker

kubectl label node se4 node-role.kubernetes.io/worker=worker

Artık Jetson Mate & Jetson Nano modüllerinizde çalışan kendi Kubernetes kümenizi oluşturmuş oldunuz! Buradan, küme üzerinde veri analitiği veya makine öğrenimi iş yüklerini çalıştırmak için bir Jupyter çalışma zamanı kullanmak gibi çeşitli şeyler yapabilirsiniz!

Bunu nasıl yapabileceğinizi daha fazla okumak için Seeed Wiki Sayfası‘nı ziyaret ettiğinizden emin olun!

Özet & Daha Fazla Kaynak

Ve bu, kenar GPU kümeleri üzerine bugünkü makalenin sonuna geldi! Güçlü hesaplama artık merkezi veri merkezleri veya bulut hizmetlerine özgü değil ve Jetson Mate ve Jetson modüllerinin yardımıyla kenar bilişim uygulamalarında kolayca gerçekleştirilebilir.

Hesaplama alanı, güçlü kenar bilişim yeteneklerine daha fazla bağımlılık yönünde ilerledikçe, kenar GPU kümeleri kesinlikle bugün keşfetmeye başlamanız gereken öncü bir çözümdür!

Kenar bilişim uygulamaları ve kümeleme hakkında daha fazla bilgi edinmek için aşağıdaki makaleleri okuyabilirsiniz: