Makine öğreniminin, günlük görevlerinizden daha fazla hesaplama gücü gerektirdiği neredeyse herkesçe bilinen bir gerçektir. Google, NVIDIA, Intel ve diğerlerinden gelen TPU’lar, tensor çekirdekleri ve GPU’lar gibi çeşitli seçeneklerle, Edge ML görevleri için donanım seçmek giderek daha zor hale geliyor. Bu makalede, piyasada mevcut olan teknolojilere ve makine öğrenimi eğitimi ile kenarda çıkarım yapmak için donanım seçeneklerinize ışık tutmayı amaçlıyorum. Haydi başlayalım!

Makine Öğreniminin Arkasında Neler Oluyor?

Makine öğrenimi, son yıllarda büyük ilerlemeler kaydeden geniş bir alandır. Bir bilgisayarın, verilerden öğrenerek belirli bir görevde kendi performansını otonom bir şekilde geliştirebileceği prensibine dayanır – bazen insanların yeteneklerini bile aşarak.

Bugün, makine öğrenimi birçok ileri düzey görevi yerine getirebiliyor, bunlar arasında ancak bunlarla sınırlı olmamak üzere:

- Görüntü Sınıflandırma / Nesne Tespiti

- Ses Ortamı / Konuşma Tanıma

- Öngörü (Örn. Hava Durumu & Hisse Senedi Piyasaları)

- Anomali Tespiti

Sinir Ağları & Donanım Sıkıntısı

Bu son makine öğrenimi gelişmelerinin bazıları, insan beyninden esinlenerek modellenmiş Sinir Ağları sayesinde mümkün olmuştur.

Ağdaki her yapay nöron, bir ağırlık taşıyan doğrusal olmayan bir fonksiyon olarak uygulanır ve modelin çıktısı üzerinde “oy veren” birden fazla katmanda düzenlenir. Modern Derin Sinir Ağları (DNN’ler), yüzlerce katmanda düzenlenmiş binlerce nöron kullanabilir, ancak bu donanım için neden önemlidir?

Aslında, sır, makine öğrenimi eğitimi ve çıkarım sürecinde neler olduğunda yatıyor. Teknik ayrıntılara girmeden, sinir ağlarının eğitim süreci verileri modelin içinden sürekli ileri ve geri geçirerek her bir nöronun ağırlıklarını kademeli olarak ayarlamayı içerir. Küçük bir ağ için bu sadece birkaç hesaplama olabilir, ancak DNN’lerden bahsettiğimizde bu hızla devasa bir ölçeğe ulaşır!

Bir modelle çıkarım (tahmin yapma) yapmak için sadece ileri geçiş gereklidir, bu da hesaplama gereksinimini hafifletir. Ancak, uygun donanımınız yoksa, ML modeliniz gerçek zamanlı uygulamalar için çok yavaş çalışabilir!

Sinir ağları ile makine öğreniminin arkasındaki matematik hakkında daha fazla bilgi edinmek için, Gavril Ognjanovski’nin harika bir makalesi var!

Not: Makine öğrenimi modellerinin eğitimi için gereken muazzam güç nedeniyle, kenarda makine öğrenimi modellerinin eğitilmesi pratik değildir. Bunun yerine, Edge ML uygulamaları yalnızca çıkarım yapacaktır (eğitilmiş bir modelden çıktı üretmek).

Çözüm: Özel Donanım

Makine öğrenimi ilerledikçe, endüstrinin artan hesaplama yüklerini desteklemek için donanımda da ayak uydurmaya çalışması şaşırtıcı değil. Bunlar, CPU’lar (Merkezi İşlem Birimleri), GPU’lar (Grafik İşlem Birimleri) ve DNN’ler için gerekli hesaplamaları desteklemek üzere özel olarak özelleştirilmiş yeni ASIC’leri (Uygulamaya Özel Entegre Devreler) içermektedir!

Bugün, makine öğrenimi için aşağıdaki donanım parçalarından bahsedeceğim:

- Google’ın TPU’ları

- NVIDIA’nın GPU’ları

- Intel’in FPGA’ları & ASIC’leri

- TinyML: Çıkarım için Mikrodenetleyici Birimleri

- Eğitim & Dağıtım için Bulut Bilişim

Google’ın Tensor İşlem Birimleri

Tensor İşlem Birimleri (TPU’lar), Google’ın sinir ağı makine öğrenimi için özel olarak tasarlanmış ASIC’leridir. Özellikle, Google’ın kendi TensorFlow makine öğrenimi çerçevesi ile kullanılmak üzere tasarlanmıştır.

Google’ın TPU’ları Nerelerde Bulunur?

Google, veri merkezlerinde makine öğrenimi iş yüklerini hızlandırmak için TPU’ları bulut altyapısının bir parçası olarak kullanmaktadır. Kenar uygulamaları için, Google’ın ilk TPU’su 2016 yılında tanıtıldı ve bu, günümüzde oldukça popüler olan en son Edge TPU‘ya evrildi.

Edge TPU, farklı donanım yapılandırmalarında makine öğrenimi iş yüklerini yönetebilmesi için Coral markası altında çeşitli ürünlere entegre edilmiştir. Örneğin, Edge TPU, tek kart bilgisayarlar (SBC’ler), modüller üzerindeki sistemler (SoM’ler), USB aksesuarları, mini PCI-e ve daha fazlasında uygulanmıştır!

Google’ın Edge TPU’su Neler Yapabilir?

Edge TPU yalnızca TensorFlow lite’ı çalıştırabilir, bu da kenar cihazları için tam TensorFlow’un performans ve kaynak açısından optimize edilmiş bir versiyonudur. Sadece ileri geçiş işlemlerinin hızlandırılabileceğini unutmayın, bu da Edge TPU’nun makine öğrenimi çıkarımları (eğitim yerine) gerçekleştirmek için daha yararlı olduğu anlamına gelir. Ayrıca, Edge TPU yalnızca 8-bit işlemleri destekler, bu nedenle üzerinde çalıştırmak istediğiniz modellerin önce optimize edilmesi gerekir.

Bu kısıtlamalara rağmen, Google’ın TPU’ları, kenar makine öğrenimi için önemli bir güç sunarken enerji verimli kalmaktadır. Örneğin, Google, Edge TPU’nun kullanıcıların MobileNetv2 gibi en son mobil görsel modelleri neredeyse 400 FPS hızında çalıştırmalarını sağlayacağını belirtmektedir!

İşlemci sayılarıyla daha çok ilgilenenler için, bu:

- Saniyede 4 Trilyon (sabit nokta) işlem (4 TOPS),

- 2 watt güçte (1 watt başına 2 TOPS)!

Google Edge TPU ile Başlarken

Eğer Google Edge TPU ile bazı seçenekleri keşfetmek için sabırsızlanıyorsanız, bugün sizin için en popüler önerilerim var!

Coral Geliştirici Kartı – 1GB RAM Versiyonu

Coral Geliştirici kartı, cihaz üzerinde makine öğrenimi ürünleri ve uygulamaları hızlı bir şekilde prototiplemenizi sağlayan hepsi bir arada bir platformdur. Esnek SoM tasarımı sayesinde üretime kolayca ölçeklenebilir! Debian Linux çalıştırabilen ve zengin çevre birimleriyle donatılmış olan Coral Geliştirici Kartı, her türlü ML amacı için yerleşik Edge TPU’sundan yararlanmak için iyi bir şekilde donatılmıştır.

Coral Geliştirici Kartı hakkında daha fazla bilgi edinmek için lütfen ürün sayfasını ziyaret edin!

Coral USB Hızlandırıcı

Mevcut geliştirme kartlarınızla Google’ın Edge TPU’sunu kullanmak isteyenler için, Coral USB Hızlandırıcı en iyi seçeneğinizdir. USB aksesuarı olarak paketlenmiş olan bu cihaz, herhangi bir Linux SBC ile kolayca arayüz oluşturabilir ve makine öğrenimi iş yüklerini hızlandırabilir, örneğin Raspberry Pi ile!

“`html

Coral USB Accelerator hakkında daha fazla bilgi edinmek ister misiniz? Şimdi ürün sayfasını ziyaret edin!

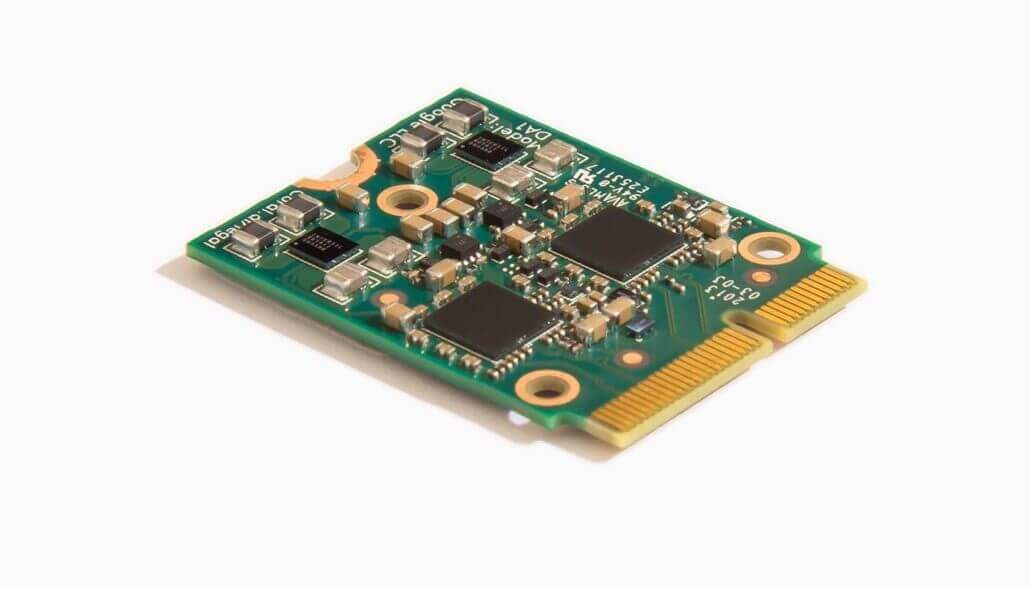

Çift Edge TPU’ya sahip Coral M.2 Hızlandırıcı

Coral M.2 Hızlandırıcı, daha büyük makine öğrenimi iş yüklerinizi yönetmek için bir değil, iki Edge TPU ile donatılmıştır. Esnek ve yaygın M.2 konektörü ile bu modülü çoğu Debian tabanlı Linux veya Windows 10 sistemleriyle kullanabilirsiniz!

Çift Edge TPU’ya sahip Coral M.2 Hızlandırıcı hakkında daha fazla bilgi edinmek için Seeed Online Store’u ziyaret edin!

NVIDIA’nın Grafik İşlem Birimleri

NVIDIA’nın grafik kartları (veya GPU’lar) uzun zamandır AI endüstrisinin büyük bir parçası oldu, ancak grafiklerin makine öğrenimi ile ne ilgisi var? Aslında cevap, grafiksel renderlamayı destekleyen donanımda yatıyor. Bir CPU ile karşılaştırıldığında, bir GPU genellikle daha fazla mantıksal çekirdek (veya aritmetik mantık birimi) bulundurur, bu da birçok işlemi paralel olarak çalıştırmasına olanak tanır! Teorik olarak, bu, GPU’ların CPU’lardan çok daha fazla işlem yapabileceği anlamına gelir, bu da makine öğreniminin performansını önemli ölçüde hızlandırır.

NVIDIA’nın GPU’ları ne yapabilir?

NVIDIA, kendi Turing Mimarisi üzerine inşa edilmiş etkileyici bir kurumsal veya masaüstü sınıf GPU’lar serisine sahiptir ve kenarda makine öğrenimini destekleyen bir dizi geliştirici kiti sunmaktadır. Çoğu, makine öğrenimi performanslarını hızlandırmak için CUDA çekirdekleri, Tensor çekirdekleri ve CuDNN kütüphaneleri gibi özellikler içerir.

CUDA Çekirdekleri, Compute Unified Device Architecture’ın kısaltmasıdır ve NVIDIA’nın CUDA destekli GPU’ları ile genel amaçlı hesaplama yapmayı sağlar, böylece paralel işleme yeteneklerinden yararlanabilirsiniz.

Tensor Çekirdekleri, derin öğrenmeyi ölçeklendirmede NVIDIA’nın temel ayırt edici özelliğidir ve Sinir Ağı eğitimi ve çıkarımı için matris hesaplamalarında 125 TFLOPS (trilyon kayan nokta işlemi/saniye) optimize edilmiş performans sunar.

CuDNN Kütüphaneleri, geliştiricilere derin öğrenme uygulamaları ve ağları için Tensor Çekirdeklerini kullanma konusunda geliştirilmiş bir arayüz sağlar.

NVIDIA’nın Kenar ML Ürünleri

NVIDIA, daha güçlü GPU serileri ile büyük başarılar elde etmişken, NVIDIA Jetson Nano ve NVIDIA Jetson Xavier NX geliştirici kitlerindeki Kenar ML ürünleri de göz ardı edilecek gibi değil. Her ikisi de NVIDIA’nın JetPack SDK ile uyumludur ve şunları içerir:

- Önyükleyici, Linux çekirdeği, Yazılımlar & Sürücüler

- TensorRT – NVIDIA’nın yüksek performanslı derin öğrenme çıkarım çalışma zamanı

- cuDNN Kütüphanesi, CUDA Toolkit

- VisionWorks – Bilgisayarla Görme için yazılım geliştirme paketi

NVIDIA Jetson Xavier NX Geliştirici Kiti

Jerson Xavier NX, NVIDIA’nın kenar geliştirme için sunduğu en güçlü platformdur. 384 CUDA çekirdeği ve 48 Tensor çekirdeği ile donatılmıştır, 6 TFLOPS (FP16) ve 21 TOPS (INT8) olağanüstü performans sunabilir!

NVIDIA Jetson Xavier NX hakkında daha fazla bilgi edinmek ister misiniz? Seeed Online Store‘u ziyaret edin!

NVIDIA Jetson Nano 2GB Geliştirici Kiti

Daha uygun fiyatlı bir seçenek arıyorsanız, NVIDIA Jetson Nano Geliştirici Kitini tercih edin! CUDA veya Tensor çekirdeklerine sahip olduğu belirtilmese de, güçlü 128 çekirdekli NVIDIA Maxwell GPU ve Jetpack SDK ile desteklenmektedir. Bu, eğitimciler, öğrenciler ve meraklılar için mükemmel bir giriş seviyesi seçeneğidir ve bütçenizi zorlamaz!

Kendi NVIDIA Jetson Nano Geliştirici Kitinizi Seeed Online Store‘dan alın!

Intel’in Kenar ML Ürün Serisi

AI araştırmaları alanında Intel, hem veri merkezi iş yükleri hem de kenarda düşük güç tüketimli makine öğrenimi için donanım üreterek hesaplama sınırlarını zorlamaya devam ediyor. Çeşitli ürün yelpazesi arasında, FPGA’larına ve Movidius VPU’suna odaklanacağız!

Intel’in AI FPGA’ları

FPGA’lar, yani Alan Programlanabilir Kapı Dizileri, yapılandırılabilir bloklardan oluşan boş bir tuval entegre devrelerdir. Bu, onları makine öğrenimi gibi yüksek performanslı, düşük gecikmeli uygulamalar için özel olarak özelleştirmenizi sağlar!

Intel, çeşitli özellikler ve avantajlar sunan geniş bir FPGA yelpazesi sunmaktadır. Örneğin, Intel® Stratix® 10 NX FPGA’ları, 143 INT8 TOPS veya 286 INT4 TOPS performans sunan bir AI Tensor Bloğu ile donatılmıştır – oldukça etkileyici bir performans! FPGA’lar, kullanım alanları ve ASIC’lerle karşılaştırmaları hakkında daha fazla bilgi edinmek için lütfen önceki makaleme göz atın.

Intel Movidius VPU

Intel’in Movidius™ Myriad™ X Görüntü İşleme Birimi (VPU), kenarda görsel zekayı güçlendirmek için özel olarak tasarlanmıştır. VPU’nun 1 TOPS’tan fazla hesaplama performansına ulaşmasını sağlayan bir Sinirsel Hesaplama Motoru içerir.

Ayrıca, Intel Movidius™ Myriad™ X VPU, aşağıdakilerle donatılmıştır:

“`

- 16 Programlanabilir 128-bit VLIW Vektör İşlemcisi, Eşzamanlı Görüntüleme ve Görüş Uygulama Boru Hatları için

- Ekstra Yük Olmadan Optimize Edilmiş Hesaplama için Gelişmiş Görüş Hızlandırıcıları

Intel Movidius MA245X AI Kiti, Intel Movidius Stick ile Uyumlu [HornedSungem]

HornedSungem AI kiti, Intel’in Movidius MA245X VPU’suna dayanmaktadır ve tak-çalıştır işlevselliği göz önünde bulundurularak tasarlanmıştır. Çeşitli PC’ler ve Raspberry Pi gibi SBC’lerle yüksek uyumluluğa sahiptir ve yüz tespiti, tanıma, nesne tespiti gibi bilgisayarla görme işlevlerini uygulamak için entegre edilebilir!

Intel Movidius MA245X AI Kiti hakkında daha fazla bilgi edinmek isterseniz, Seeed Online Store‘u ziyaret edin!

TinyML: Mikrodenetleyicilerde Kenar ML Çıkarımı?

Şu ana kadar, eğitim ve çıkarım için özel donanımlardan bahsettik ve ML çıkarımının eğitimden çok daha az hesaplama donanımı kullandığını biliyoruz. TinyML sayesinde, en küçük kenar cihazlarında ML çıkarımını kullanan uygulamaları görmeye başlıyoruz.

Evet – mikrodenetleyicileri de dahil!

TinyML, Küçük Makine Öğrenimi’nin kısaltmasıdır ve makine öğrenimi modellerinin gerektirdiği hesaplama alanı ve gücü azaltmak için optimizasyon teknikleri kullanır. Özellikle, ML çıkarım uygulamalarını kompakt, enerji verimli ve en önemlisi uygun fiyatlı mikrodenetleyici birimlerine (MCU’lar) getirmeyi hedefler.

TinyML hareketini daha da destekleyen Edge Impulse ve OpenMV gibi şirketler, kullanıcı dostu platformlar aracılığıyla Kenar AI’yi herkes için daha erişilebilir hale getiriyor. MCU’ların çok yönlülüğü ile, bugün makine öğrenimi araştırma ve geliştirme alanlarının en popülerlerinden biri olmaları şaşırtıcı değil!

Kenar AI için En İyi Mikrodenetleyiciler

Yazılım iyileştirmeleri ile yarı yolda buluşan mikrodenetleyiciler, her yıl daha iyi ve güçlü mikroişlemcilerle daha güçlü donanım performansının tadını çıkarıyor. Piyasada birçok mikrodenetleyici seçeneği olduğundan, bilinçli bir karar vermek zor olabilir. Bugün, kenarda makine öğrenimi için aşağıdaki mikrodenetleyici önerileri ile sizi bilgilendirdim!

Seeeduino XIAO

Seeeduino XIAO, Seeeduino Ailesi’ndeki en küçük Arduino uyumlu karttır. Küçük boyutuna rağmen, Seeeduino XIAO güçlü SAMD21 mikroçipi ve çeşitli donanım arayüzleri ile donatılmıştır – gerçekten TinyML’de küçüklüğü temsil ediyor!

Ürün Özellikleri:

- 256KB Flash, 32KB SRAM ile ARM Cortex-M0+ 32bit 48MHz mikrodenetleyici (SAMD21G18)

- Arduino IDE & MicroPython ile uyumlu

- Kolay Proje İşlemi: Breadboard dostu

- Küçük Boyut: Giyilebilir cihazlar ve küçük projeler için parmak büyüklüğünde (20×17.5mm)

- Birden fazla geliştirme arayüzü: 11 dijital/analog pin, 10 PWM Pin, 1 DAC çıkışı, 1 SWD Bağlantı pad arayüzü, 1 I2C arayüzü, 1 UART arayüzü, 1 SPI arayüzü.

Seeeduino XIAO hakkında daha fazla bilgi edinmek ister misiniz? Şimdi ürün sayfasını ziyaret edin!

Wio Terminal

Wio Terminal, ATSAMD51 tabanlı tam bir Arduino geliştirme platformudur ve Realtek RTL8720DN tarafından desteklenen kablosuz bağlantıya sahiptir. Hepsi bir arada mikrodenetleyici olarak, üzerinde 2.4” LCD Ekran, IMU, mikrofon, buzzer, microSD kart yuvası, ışık sensörü ve kızılötesi verici bulunmaktadır. Wio Terminal, Edge Impulse tarafından resmi olarak desteklenmektedir, bu da verileri toplamak, makine öğrenimi modelinizi eğitmek ve nihayetinde optimize edilmiş bir ML uygulaması dağıtmak için kolayca kullanabileceğiniz anlamına geliyor!

Ürün Özellikleri:

- Güçlü MCU: 120MHz’de çalışan ARM Cortex-M4F çekirdekli Microchip ATSAMD51P19

- Güvenilir Kablosuz Bağlantı: Realtek RTL8720DN ile donatılmış, çift bant 2.4GHz / 5GHz Wi-Fi (sadece Arduino tarafından desteklenmektedir)

- Yüksek Entegre Tasarım: 2.4” LCD Ekran, IMU ve daha pratik ek bileşenler, yerleşik mıknatıslar ve montaj delikleri ile kompakt bir kasada yer almaktadır

- Raspberry Pi 40-pin Uyumlu GPIO

- IoT ile keşfetmek için 300’den fazla tak-çalıştır Grove modülü ile uyumlu

- USB OTG Desteği

- Arduino, CircuitPython, Micropython, ArduPy, AT Firmware, Visual Studio Code desteği

- TELEC Sertifikalı

Wio Terminal almakla ilgileniyorsanız, lütfen ürün sayfasını ziyaret edin!

Bulut Bilişim

Diğer yandan, ağır makine öğrenimi eğitimi yapabilen donanım arıyorsanız, bulut bilişim sizin için uygun olabilir. Makine Öğreniminde Bulut Bilişim’in genel fikri, eğitim veya çıkarım için gereken işlem gücünün yerel cihazdan soyutlanmasıdır.

Bulut bilişim çok esnektir – hem makine öğrenimi eğitimi hem de dağıtımı için kullanılabilir!

Eğitim – Büyük veri setlerinde model eğitimi için kaynak yoğun hesaplamalar gerçekleştirin.

Dağıtım – Eğitimli modellerle bulutta makine öğrenimi uygulamalarını barındırın, kenar cihazlardan gelen giriş verilerine yanıt verin ve modellerin çıktısını döndürün.

Bulut Bilişimin Avantajları

Ortalama bir tüketici veya meraklı için bulut bilişimin en basit faydası uygun fiyat ve erişilebilirlik‘tir. Örneğin, makine öğrenimi için güçlü bir GPU satın almak, modern uygulamalar için birkaç bin dolara mal olabilir.

Ancak, sermaye maliyetlerinin hizmet sağlayıcı tarafından karşılandığı bir bulut bilişim kullanırsak, yalnızca kullandığımız işlem gücü için ödeme yapmamız gerekecek. Genel olarak, bu birey için daha düşük maliyetler anlamına gelir! Ayrıca, bulut hizmetlerinin nispeten güncel ve güçlü donanım sağlamasını bekleyebilirsiniz, bu da güncel kalmak için ek nakit harcamanız gerekmeyeceği anlamına gelir.

Diğer bir avantaj ise verilere erişim‘dir. Tüm IoT cihazları bulut aracılığıyla bağlı olduğundan, bu merkezi bilgisayarlar birçok veri akışından yararlanabilir. Bu nedenle, daha sağlam modeller eğitebilir ve örneğin, tedarik zinciri performansı hakkında daha fazla içgörü elde edebiliriz. Ayrıca, bulut bilişimin merkezi doğası, iş akışlarını ve çerçeveleri güncellemeyi daha kolay hale getirir.

Popüler Bulut Bilişim Platformları

Bulut ve IoT talebi arttıkça, Amazon, Google ve Microsoft gibi birçok bulut bilişim platformu piyasada görünmeye başlamaktadır. Genel olarak benzer hizmetler sunsalar da, kullanıcı deneyimi ve yeteneklerinde önemli farklılıklar vardır. Bence, bulut bilişim platformu seçiminiz nihayetinde maliyet ve kişisel tercihlere dayanacaktır!

Amazon Web Services

Amazon Web Services (AWS), Amazon tarafından işletilen bulut bilişim platformudur ve veri depolama ve analiz dahil olmak üzere talep üzerine hizmetler sunmaktadır. AWS’yi popüler yapan belki de, özel görevler için son derece spesifik bulut bilişim örnekleri oluşturmak amacıyla CPU’lar, GPU’lar, depolama ve RAM gibi gerçek donanımları tahsis etme yeteneğidir!

Makine öğrenimi için, AWS, en son NVIDIA A100 Tensor Core GPU’larla donatılmış Amazon EC2 P4d örneklerini sunmaktadır. Ayrıca, veri çıkarma / iş analizi için arama ve öneri motorları gibi hemen dağıtılabilir çeşitli AI destekli uygulamalar da sunmaktadırlar.

Google Cloud Platform

Google Cloud Platform (GCP), Google tarafından işletilmektedir ve bilişim, ağ, depolama, makine öğrenimi ve IoT için kapsamlı bir hizmet yelpazesi sunmaktadır. AWS’ye benzer şekilde, Google Cloud ML Engine de makine öğrenimi iş yüklerini buluta aktarmak için donanım tahsis etmenizi sağlar. GCP ayrıca, Google’ın Ses Tanıma, Görüntü AI ve Dialogflow gibi makine öğrenimi API’lerine erişim sağlar.

Büyük veri setlerini işlemek için GCP, petabaytlarca veriyi verimli bir şekilde SQL sözdizimi ile analiz etmenizi sağlayan BigQuery’yi kullanmaktadır. BigQuery ML ile SQL içinde makine öğrenimi modelleri doğrudan ve kolayca oluşturabilirsiniz.

Özel Not: Google Colaboratory

Google ayrıca, veri bilimi ve makine öğreniminde yaygın olarak kullanılan Jupyter not defterlerini çalıştırmanıza olanak tanıyan çevrimiçi bir çalışma zamanı olan Colaboratory‘yi sunmaktadır. İşte harika kısım: Ücretsiz bir kullanıcı olarak bile makine öğrenimi iş yükleri için bir GPU tahsis edilecektir! Daha güçlü bir GPU’ya ihtiyacınız varsa, ayrıca ayda 10 dolara Google Colab Pro’ya yükseltebilirsiniz.

Microsoft Azure

Microsoft Azure, Microsoft’un bulut bilişim hizmetidir ve sanal makinelerden veri akışlarına, IoT’ye kadar geniş bir bulut ürün ve hizmet yelpazesi sunmaktadır. Makine öğrenimi için, Azure Machine Learning, bulut kaynaklarından yararlanarak makine öğrenimi modellerini kolayca oluşturmanıza, eğitmenize ve dağıtmanıza olanak tanır. Ayrıca, Azure Cognitive Search, Azure Bot Services ve Azure Cognitive Services gibi Microsoft’un kendi AI ürün yelpazesini de kullanabileceksiniz.

Sonuç

Bu makaleyi özetlemek gerekirse, makine öğreniminin donanım gereksinimlerini karşılamanın birçok yolu vardır. Öncelikle, hem eğitim hem de çıkarım için Google, NVIDIA ve Intel tarafından sunulan özel donanım ve ürünleri ele aldık. Ardından, mikrodenetleyiciler için TinyML ile Edge AI çıkarımları etrafındaki yeni olanakları konuştuk. Son olarak, maliyetleri düşürmek ve makine öğrenimi projelerimiz için bulut hizmetlerinden yararlanmak amacıyla çeşitli bulut bilişim seçeneklerini de tartıştık.

Sonuç olarak, hangi ürün veya hizmeti seçeceğiniz ihtiyaçlarınıza ve bütçenize büyük ölçüde bağlı olacaktır. Yine de, elinizdeki araçlar hakkında daha net bir resim elde ettiğinizi ve makine öğrenimi projelerinizi ele almak için daha iyi bir şekilde hazırlandığınızı umuyorum!

Daha fazla bilgi edinmek isterseniz, size yardımcı olabilecek bazı kaynaklar burada:

- Edge AI – Nedir ve Edge IoT için ne yapabilir?

- AWS vs Azure vs Google Cloud: En iyi kurumsal bulut platformu hangisi? – ComputerWorld

- GPU nedir ve derin öğrenimde birine ihtiyacınız var mı? – TowardsDataScience