Kenar bilişim, günümüzün IoT bağlantılı dünyasında büyük bir önem ve uygulama alanı artışı gördü. Bu alanda, kenar üzerinde küme bilişim, GPU kümeleme dahil olmak üzere, bulut bilişimden uzaklaşmayı kolaylaştıran önemli bir yol olmuştur; çünkü büyük miktarda hesaplama gücünü kompakt ve taşınabilir form faktörlerinde sunar. Bu makalede, NVIDIA Jetson Küme’lerini kullanarak kenar bilişim uygulamalarınızı bir üst seviyeye nasıl çıkarabileceğinizi özel olarak tartışacağız!

Aşağıdaki içerikleri ve daha fazlasını ele alacağız!

- GPU Kümesi nedir?

- NVIDIA Jetson Kümesi nedir & Faydaları nelerdir?

- GPU Küme Uygulamaları & Örnekleri

- NVIDIA Jetson Kümesi Oluşturma: Donanım Önerileri

- Öğretici: GPU Destekli Hesaplama için NVIDIA Jetson Kümesi ile Kubernetes Kullanma

Kenar Üzerinde GPU Kümeleme Nedir?

Kenar GPU kümeleri, kenar üzerinde dağıtılan, kenar bilişim amaçları için GPU’lar (Grafik İşlem Birimleri) taşıyan bilgisayar kümeleridir. Kenar bilişim ise, uygulamalarının yerel alanında fiziksel olarak bulunan cihazlarda gerçekleştirilen hesaplama görevlerini tanımlar. Bu, bu süreçlerin uzaktan yönetildiği bulut bilişimle zıt bir durumdur.

Öncelikle, Küme Bilişim Nedir?

Bilgisayar kümeleri, birlikte çalışan bilgisayarlar grubunu tanımlar; böylece tek bir sistem olarak görülebilirler. Bir küme, genellikle güçlü iş yüklerini işlemek için sistemdeki birden fazla bilgisayar arasında görevleri dağıtarak kullanılır. Üç ana küme türü vardır; her biri farklı amaçlara hizmet eder ve küme bilişime kendi fayda setlerini katkıda bulunur!

- Yüksek Erişilebilirlik – Bir arıza durumunda talepleri başka bir düğüme yönlendirerek uygulamaların her zaman erişilebilir olmasını sağlar.

- Yük Dengeleme – Yüksek iş hacimlerini yönetmek için hesaplama iş yüklerini köle düğümler arasında eşit şekilde dağıtır.

- Yüksek Performans – Yüksek hesaplama gereksinimleri olan görevler için hesaplama gücünü artırmak amacıyla birden fazla köle düğüm paralel olarak kullanılır.

Küme Bilişim + GPU’lar = GPU Kümeleri

Adından da anlaşılacağı gibi, GPU Kümeleri, GPU’larla donatılmış bilgisayarlardan oluşur. GPU’lar, merkezi işlem birimleri (CPU) ile karşılaştırıldığında, paralel hesaplama konusunda uzmanlaşmıştır. Karmaşık problemleri, hepsini bir arada hesaplamak için çok daha küçük görevlere bölerler; böylece yüksek verimlilikte hesaplama elde edilir.

Geleneksel olarak, grafik işleme yalnızca GPU’lardan faydalandı; çünkü dokuların, aydınlatmanın ve şekillerin render edilmesi, düzgün hareketli grafikler üretmek için aynı anda yapılması gerekiyordu. Ancak, modern GPU çerçeveleri ile, paralel hesaplama yetenekleri artık veri işleme ve makine öğrenimi gibi diğer alanlara da genişletilebilir – Genel Amaçlı GPU’lar veya GPGPU’lar doğmuştur!

Önceki makalelerimde hem Küme Bilişim hem de GPU Kümeleri konularını derinlemesine ele aldım, bu yüzden daha fazla ayrıntı için onları kontrol etmeyi unutmayın!

NVIDIA Jetson Kümeleri Nedir & Neden Kullanmalısınız?

Geleneksel olarak, küme bilişim bulut bilişime özgüydü, ancak Tek Kartlı Bilgisayarlar (SBC’ler) ve ağ altyapısındaki ilerlemelerle bu durum artık geçerli değil. Bu bölümde, NVIDIA Jetson Kümelerini inceleyeceğiz; bu, NVIDIA’nın Jetson modüllerinden oluşturulmuş GPU Kümeleridir ve kenar bilişim uygulamalarınız için neden bunu düşünmeniz gerektiğini tartışacağız!

NVIDIA Jetson Serisini Tanıyalım

NVIDIA’nın Jetson modülleri, kenar üzerinde yazılımları etkili bir şekilde çalıştırmak için harika performans ve enerji verimliliği sağlayan GPU destekli hesaplama modülleridir. GPU yetenekleri, bu modüllerin AI destekli Ağ Video Kaydedicileri (NVR’ler), hassas üretimde otomatik optik muayene sistemleri ve otonom robotlar gibi daha yüksek performans gerektiren bir dizi uygulamayı güçlendirmesine olanak tanır!

Ayrıca, NVIDIA’nın yarı iletken endüstrisindeki itibarı mükemmeldir. GPU’ları, dünya genelindeki GPU uygulamalarının çoğunu güçlendirdiğinden, NVIDIA yıllardır geniş bir tüketici, endüstri ve araştırma uygulamaları yelpazesi için yüksek kaliteli GPU’lar tasarlayıp üretmektedir. Doğal olarak, NVIDIA Jetson serisi de istisna değildir; harika yapı kalitesi ve performans sunar!

CUDA & NVIDIA Jetpack

NVIDIA’nın ürünlerindeki harika donanımın ötesinde, NVIDIA Jetson destekli bir GPU kümesi çalıştırmanın en büyük avantajının yazılım yeteneklerinde, yani CUDA & NVIDIA Jetpack uyumluluğunda yattığı söylenebilir.

CUDA, NVIDIA’nın endüstri lideri özel GPGPU çerçevesidir ve GPU’larla uygulama geliştirmek için programlama yapar. GPU hızlandırmalı kütüphaneler, hata ayıklama ve optimizasyon araçları, bir C/C++ derleyicisi ve çeşitli bilgisayar mimarilerinde uygulamanızı oluşturup dağıtmanızı sağlayan bir çalışma zamanı kütüphanesi içerir. Mükemmel destek, entegrasyon ve birçok GPU uygulamasıyla geliştirme uyumluluğu ile CUDA, dünya genelindeki geliştiriciler tarafından tercih edilen bir seçimdir.

NVIDIA’nın Jetpack SDK’sı AI uygulamaları oluşturmak için NVIDIA’dan kapsamlı bir çözümdür ve tüm Jetson modüllerini & geliştirici kitlerini destekler. Bir Linux işletim sistemi, CUDA-X hızlandırmalı kütüphaneler ve Derin Öğrenme, Bilgisayarla Görme, Hızlandırılmış Hesaplama ve Multimedya için API’ler içerir. Daha da iyisi, geliştirme sürecinizi kolaylaştıracak örnekler, belgeler ve geliştirici araçları içerir!

Bu nedenle, NVIDIA Jetson ürünleriyle güçlendirilmiş bir GPU kümesi oluşturmak, yalnızca güçlü donanım sağlamakla kalmaz, aynı zamanda geliştirme sürecinizi hızlandıracak kullanımı kolay yazılım ve kütüphanelerle de donatılmıştır!

“`html

NVIDIA Jetson Küme Oluşturma Jetson Mate ile

Yani kendi NVIDIA Jetson GPU kümenizi oluşturmaya karar verdiniz ve nereden başlayacağınızı arıyorsunuz. Birden fazla Jetson Nano Geliştirici Kitini bir araya getiren bazı örneklerle karşılaşmış olabilirsiniz. Bu kesinlikle işe yarıyor, ancak kablolama oldukça karmaşık hale gelebilir ve daha da kötüsü: bu form faktörü saha dağıtımı için pek uygun değil – ki bu, bir kenar bilişim sisteminin tüm amacı!

Bu zorlukların üstesinden gelmek için, Seeed, Jetson Mate ve NVIDIA’nın Jetson Nano / Xavier NX modülleri ile birlikte tam kenar GPU kümeleme çözümünü sunmaktan gurur duyar. Taşıyıcı kart ve Jetson modülleri ile birlikte, kenar uygulamaları için NVIDIA’nın sektör lideri GPU’larıyla güçlendirilmiş tam bir NVIDIA GPU Kümesi elde etmek oldukça kolay!

Artık Seeed’den tam bir kenar GPU kümesi için donanımı iki pratik paket halinde alabilirsiniz:

- Jetson Mate Küme Standart 1 Jetson Nano SoM ve 3 Jetson Xavier NX SoM ile

- Jetson Mate Küme Gelişmiş 4 Jetson Xavier NX SoM ile

Jetson Mate, Jetson Nano ve Jetson Xavier NX hakkında daha fazla bilgi edinmek için okumaya devam edin!

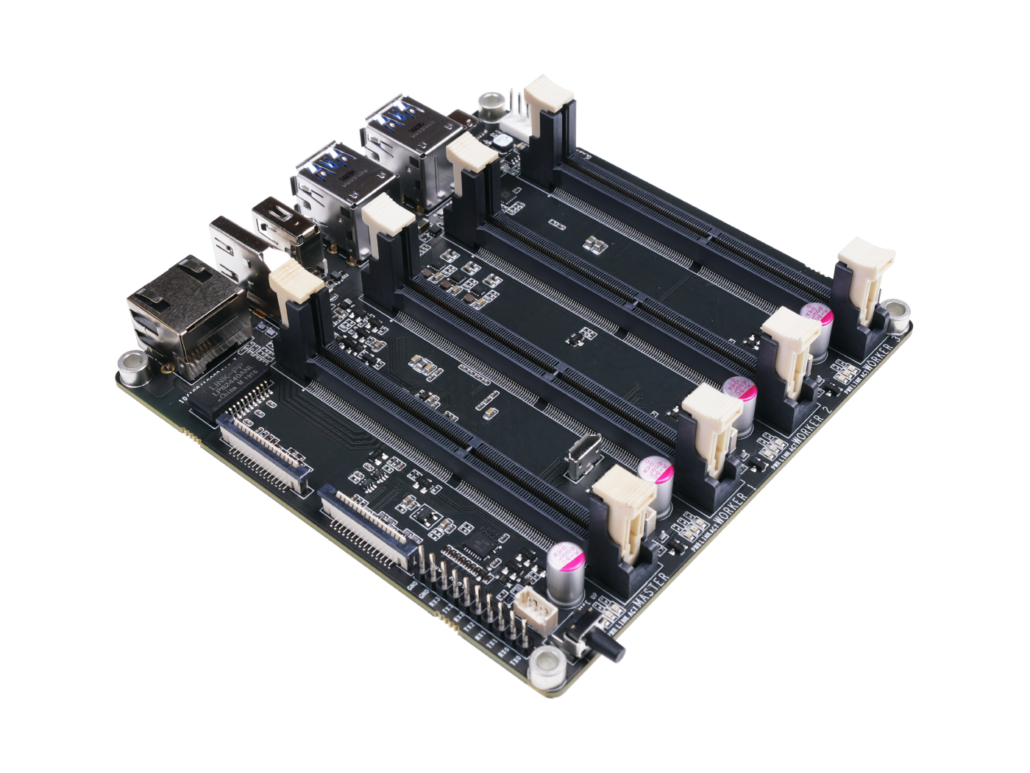

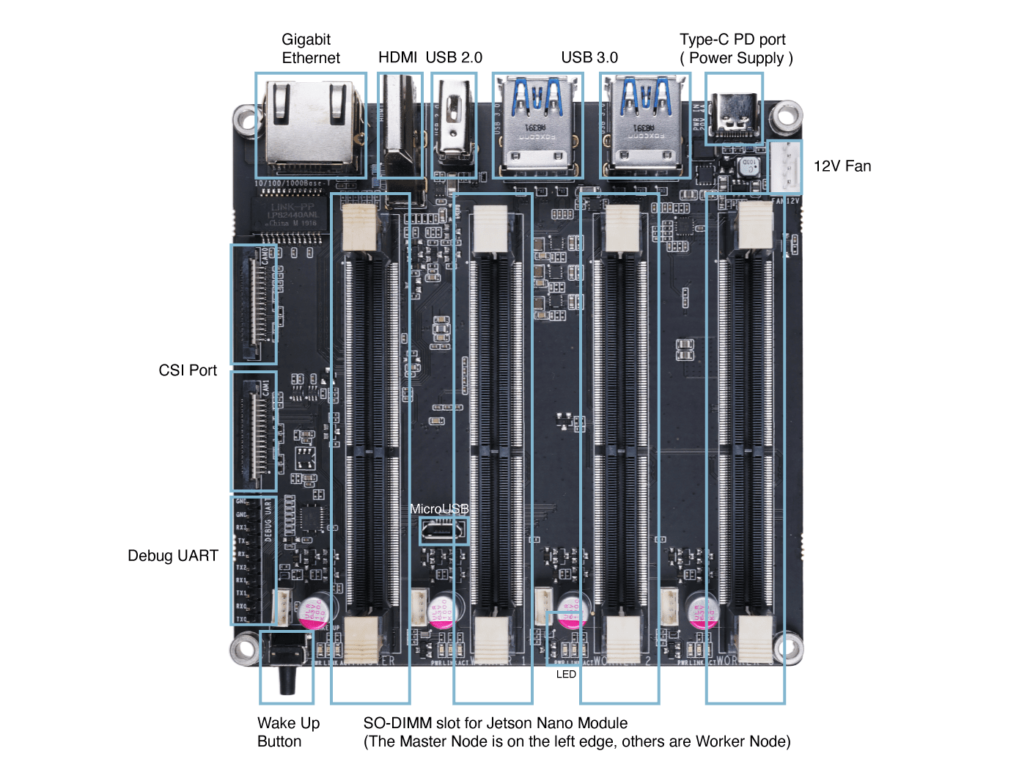

Jetson Mate’i Tanıtıyoruz

Jetson Mate taşıyıcı kartı, NVIDIA Jetson kümeleri oluşturmak için özel olarak tasarlanmış kapsamlı ve güvenilir bir çözümdür. Birbirleriyle iletişim kurabilen 4 SoM’a kadar olanak tanıyan 5 portlu gigabit anahtarı ile donatılmıştır ve 3 işçi/köle düğümü için bağımsız güç sağlar. Zengin çevre birimleri (CSI, HDMI, USB, Ethernet) ve yerleşik fanı ile Jetson Mate, kenarda NVIDIA GPU kümeleri oluşturmak için tam bir çözümdür.

Jetson Mate, kompakt form faktöründe NVIDIA’nın kendi Jetson Nano / Xavier NX SoM’larını barındırabilir ve kenarda muazzam bir hesaplama gücü sunar. Adım adım kılavuzumuzla kolayca kurulabilen tasarımı sayesinde, Jetson Mate GPU kümeleriniz için yüksek esneklik ve performans sunar.

Jetson Mate hakkında daha fazla bilgi edinmek için lütfen Seeed Online Mağazası’ndaki ürün sayfasını ziyaret edin!

NVIDIA Jetson Nano Modülü

AI uygulamaları için özel olarak tasarlanmış olan NVIDIA’nın JetPack SDK ile, Jetson Nano ve 128 NVIDIA CUDA Çekirdeği ile kenarda düşük güç tüketimi ile güçlü makine öğrenimi uygulamaları oluşturabilir, dağıtabilir ve yönetebilirsiniz.

Ürün Özellikleri:

- Dört Çekirdekli ARM Cortex-A57 MPCore İşlemci

- 128 NVIDIA CUDA Çekirdeğine sahip NVIDIA Maxwell GPU

- 1600MHz 25.6GBps hızında 4GB 64-Bit LPDDR4 Bellek

- 16GB eMMC Depolama

- AI Geliştirme için NVIDIA JetPack SDK

Kendi NVIDIA Jetson Nano Modülünüzü Seeed Online Mağazası’ndan alın!

NVIDIA® Jetson Xavier™ NX Modülü

Jetson Nano’dan biraz daha pahalı olmasına rağmen, Jetson Xavier NX modülü GPU hesaplama gücü söz konusu olduğunda tüm durakları kaldırıyor. 384 NVIDIA CUDA çekirdeği ve makine öğrenimi için 48 Tensor çekirdeği ile Jetson Xavier NX, FP16 değerleri için 6 TFLOPS (trilyon kayan nokta işlemi) ve INT8 değerleri için 21 TOPS (trilyon işlem) kapasitesine sahiptir. Aynı NVIDIA Jetpack uyumluluğuna sahip olan Jetson Xavier NX modülü, kenar bilişim uygulamanızın tüm gereksinimlerini karşılayacaktır.

Ürün Özellikleri:

- Kompakt boyutlu SoM, düşük güç tüketimi ile gelişmiş AI uygulamaları için yeterince güçlü

- Uygulama geliştirme ve optimizasyon için tüm NVIDIA Yazılım Yığını’nı destekler

- Jetson TX2’nin performansının 10 katından fazlası

- NVIDIA JetPack™ SDK kullanarak AI uygulamalarının geliştirilmesini sağlar

- Kenarda AI’yi kolayca oluşturma, dağıtma ve yönetme imkanı

- Pazar için esnek ve ölçeklenebilir bir platform, geliştirme maliyetlerini azaltır

- Ürün ömrü boyunca sürekli güncellemeler

Kendi NVIDIA Jetson Xavier NX Modülünüzü Seeed Online Mağazası’ndan alın!

NVIDIA GPU Küme Kullanımı Kenar Bilişimde

Jetson Mate & Jetson SoM’lar ile güçlendirilmiş NVIDIA GPU Küme, kenarda sınırsız bilişim uygulamaları gerçekleştirmenize yardımcı olabilir. İşte GPU kümelerinin son derece önemli hale geldiği bazı örnek kullanım senaryoları!

“`

Grafik İşleme

GPU’ların yüksek verimli genel amaçlı hesaplama yapacak şekilde nasıl evrildiğinden bahsettik, ancak bu, grafik işleme konusundaki orijinal rolünün artık geçersiz olduğu anlamına gelmiyor! Fotoğraf, video düzenleme, 3D modelleme, sanal veya artırılmış gerçeklik, GPU’ların geleneksel işlevlerine devam eden birçok modern uygulamadan sadece birkaçıdır. Ne yazık ki, ayrık GPU’larla donatılmış dizüstü bilgisayarlar büyük ve pahalıdır, oysa masaüstü çözümler birçok durumda gereken taşınabilirlikten yoksundur.

Taşınabilir ve uygun fiyatlı bir çözüm için, bir NVIDIA GPU kümesi dağıtmayı düşünün! Çok daha küçük bir form faktöründe paketlenmiş olmasına rağmen, önemli miktarda güç sunarak, grafik yoğun iş yüklerini ana bilgisayarınızdan kenar GPU kümesine aktararak yoğun grafik iş yüklerini daha verimli bir şekilde işleyebilirsiniz.

Kenar Makine Öğrenimi

NVIDIA Jetson kümeleri, kenar yapay zeka (Edge AI) veya kenar makine öğrenimi iş yüklerini işleme konusunda uzmanlaşmıştır. Makine öğrenimi, özellikle sinir ağları / derin öğrenme, gerçekleştirilecek çok sayıda hesaplama nedeniyle önemli miktarda hesaplama gücü gerektirir. Sonuç olarak, veri merkezlerinde barındırılan güçlü GPU’lar, makine öğrenimi iş yüklerinde eşzamanlı hesaplamaları işlemek için uzun zamandır vazgeçilmez olmuştur.

Ancak günümüzde bu durum artık geçerli değil. Bir NVIDIA Jetson kümesi ile, kenar makine öğrenimi için etkili çözümler geliştirmek amacıyla güçlü donanım hızlandırmasından ve optimize edilmiş makine öğrenimi kütüphanelerinden ve API’lerinden kolayca yararlanabilirsiniz. Bu şekilde, kenar cihazlarımız artık tahmin yapma, karmaşık verileri işleme ve hatta çözümleri yönetme gibi karmaşık görevleri yerine getirme yetenekleriyle daha akıllı hale getirilebilir.

Bir NVIDIA Jetson kümesi kullanmak, Edge AI’ye geçişten nasıl yararlanabileceğinize dair sadece bir örnektir. Aslında, bununla birlikte birkaç önemli fayda da gelir; bunlar arasında gecikmenin azaltılması, bant genişliği gereksiniminin ve maliyetin düşürülmesi, veri güvenliğinin artırılması ve güvenilirliğin iyileştirilmesi bulunmaktadır. Edge AI ve Edge IoT üzerindeki dönüştürücü etkileri hakkında daha fazla bilgi için önceki makaleme göz atın!

Kubernetes ile Ölçeklenebilir Uygulamalar Dağıtın

Günümüzde, Kubernetes bahsedilmeden küme hesaplaması hakkında konuşmak neredeyse imkansızdır; bu, konteynerleştirilmiş iş yüklerini ve hizmetleri yönetmek için açık kaynaklı bir platformdur. Kesinlikle mevcut olan tek çözüm değildir, ancak 2021’de bilgisayar kümelerini dağıtmanın en popüler yollarından biridir. Bunu, kaynakları gerektiği gibi artırıp azaltarak NVIDIA GPU kümelerinizi ve daha fazlasını en verimli şekilde kullanmanıza yardımcı olan bir yönetim arayüzü olarak düşünebilirsiniz!

Eğitim: NVIDIA Jetson Kümeleri ile GPU Destekli Hesaplama için Kubernetes Kullanın

Bu bölümde, Jetson Mate ve güçlü Jetson Nano modülleri ile Kubernetes çalıştıran kendi NVIDIA Jetson Kümenizi kurmanın ne kadar kolay olduğunu göstereceğim. Ayrıca, tam eğitimi Seeed Wiki sayfamızda okuyabilirsiniz.

Gerekli Malzemeler

Bu eğitimi takip etmek için aşağıdaki öğelerin önerildiğini unutmayın. En az iki Jetson Nano modülüne sahip olmanız gerektiğini unutmayın, çünkü birine ana düğüm olarak, diğerine ise işçi düğüm olarak ihtiyaç duyacağız.

- Jetson Mate Taşıyıcı Kartı

- Jetson Nano Modülü (en az 2)

- PD Protokolü ile Nitelikli Type-C Güç Adaptörü (minimum 65W)

Elbette, bireysel bileşenleri satın alma zahmetinden kaçınmak için doğrudan Jetson Mate Küme Standartı veya Jetson Mate Küme Gelişmiş seçeneklerini tercih edebilirsiniz!

Jetson OS’u Kurun ve Yapılandırın

Her bir modül için işletim sistemini NVIDIA’nın resmi SDK yöneticisi ile yapılandırmamız gerekecek.

Öncelikle, aşağıda gösterildiği gibi hedef donanımı seçin.

Daha sonra, yüklemek istediğiniz işletim sistemi ve kütüphaneleri seçin:

Dosyaları indirin ve yükleyin. İndirme sırasında, Jetson Nano hesaplama modülünü Jetson Mate’in ana düğümüne yerleştirin.

Bundan sonra, resimde gösterildiği gibi 2 GND pinini kısa devre yapın.

Jetson Mate’i bilgisayarınıza mikro USB portu aracılığıyla bağlayın ve uyandırma butonuna basarak makineyi açın.

Son adım, işletim sistemini hesaplama modülüne yüklemektir. İşletim sistemi ve yazılım kütüphanesinin yüklenmesi tamamlandığında, bir pencere açılacaktır. Manuel Kurulum seçeneğini seçin, ardından flash’a tıklayın ve tamamlanana kadar bekleyin. Hepsi bu!

Unutmayın ki tüm modüller yalnızca ana düğümde kurulu olduklarında yüklenebilir. Tüm modüllerinizi ana düğümde birer birer yükleyip yapılandırmanız gerekecektir.

Küme Üzerinde Kubernetes Çalıştırma

Sonraki adımlarda, NVIDIA Jetson Nano modüllerimizden oluşan kümemizde Kubernetes’i kurup yapılandıracağız!

Docker’ı Yapılandırma

Hem İşçi hem de Ana modüller için, docker çalışma zamanını varsayılan olarak “nvidia” olarak yapılandırmamız gerekiyor.

/etc/docker/daemon.json dosyasını aşağıdaki gibi değiştirin.

“`html

{

"default-runtime" : "nvidia",

"runtimes": {

"nvidia": {

"path": "nvidia-container-runtime",

"runtimeArgs": []

}

}

}Docker daemon’ı aşağıdaki komut ile yeniden başlatın,

sudo systemctl daemon-reload && sudo systemctl restart dockersonra Docker varsayılan çalışma zamanını NVIDIA olarak doğrulayın.

sudo docker info | grep -i runtimeİşte örnek bir çıktı:

Runtimes: nvidia runc

Default Runtime: nvidiaKubernetes Kurulumu

Hem Worker & Master modülleri için, komut satırında aşağıdaki komutlarla kubelet, kubeadm ve kubectl’i kurun.

sudo apt-get update && sudo apt-get install -y apt-transport-https curl

curl -s https://packages.cloud.google.com/apt/doc/apt-key.gpg | sudo apt-key add -

# Kubernetes deposunu ekleyin

cat <<EOF | sudo tee /etc/apt/sources.list.d/kubernetes.list

deb https://apt.kubernetes.io/ kubernetes-xenial main

EOF

sudo apt update && sudo apt install -y kubelet kubeadm kubectl

sudo apt-mark hold kubelet kubeadm kubectlSwap’ı devre dışı bırakın. Not: Her yeniden başlatmada bunu kapatmanız gerekiyor.

sudo swapoff -aİlerleyen adımlarda kullanacağımız deviceQuery’yi derleyin.

cd /usr/local/cuda/samples/1_Utilities/deviceQuery && sudo makeKubernetes’i Yapılandırma

Sadece Master modülünde, kümeyi başlatın:

sudo kubeadm init --pod-network-cidr=10.244.0.0/16Çıktı, kümeye bir pod ağı dağıtmak için çalıştırılabilecek komutları ve kümeye katılmak için komutları gösterir. Her şey başarılı olursa, çıktının sonunda buna benzer bir şey görmelisiniz:

Kubernetes kontrol düzleminiz başarıyla başlatıldı!

Kümenizi kullanmaya başlamak için, aşağıdakileri normal bir kullanıcı olarak çalıştırmanız gerekir:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

Artık kümeye bir pod ağı dağıtmalısınız.

Aşağıdaki seçeneklerden biri ile "kubectl apply -f [podnetwork].yaml" çalıştırın:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

Ardından, her birini kök olarak çalıştırarak herhangi bir sayıda worker düğümüne katılabilirsiniz:

kubeadm join 192.168.2.114:6443 --token zqqoy7.9oi8dpkfmqkop2p5 \

--discovery-token-ca-cert-hash sha256:71270ea137214422221319c1bdb9ba6d4b76abfa2506753703ed654a90c4982bÇıktıdaki talimatları izleyerek, aşağıdaki komutları çalıştırın:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/configKontrol düzlemi düğümüne bir pod-ağı eklentisi kurun. Bu durumda, calico kullanıyoruz.

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.ymlTüm pod’ların çalıştığından emin olun:

kubectl get pods --all-namespacesİşte örnek bir çıktı:

NAMESPACE NAME READY STATUS RESTARTS AGE

kube-system kube-flannel-ds-arm64-gz28t 1/1 Running 0 2m8s

kube-system coredns-5c98db65d4-d4kgh 1/1 Running 0 9m8s

kube-system coredns-5c98db65d4-h6x8m 1/1 Running 0 9m8s

kube-system etcd-#yourhost 1/1 Running 0 8m25s

kube-system kube-apiserver-#yourhost 1/1 Running 0 8m7s

kube-system kube-controller-manager-#yourhost 1/1 Running 0 8m3s

kube-system kube-proxy-6sh42 1/1 Running 0 9m7s

kube-system kube-scheduler-#yourhost 1/1 Running 0 8m26sWorker modüllerinde yalnızca, her düğümü kümeye ekleme zamanı geldi; bu, kube init komutunun sonunda sağlanan kubeadm join komutunu çalıştırmakla ilgilidir. Kümenize eklemek istediğiniz her Jetson Nano için, ana makineye giriş yapın ve şunu çalıştırın:

küme - tokenlarınız ve ca-cert-hash'leriniz değişecektir

$ sudo kubeadm join 192.168.2.114:6443 --token zqqoy7.9oi8dpkfmqkop2p5 \

--discovery-token-ca-cert-hash sha256:71270ea137214422221319c1bdb9ba6d4b76abfa2506753703ed654a90c4982bMaster düğümünde yalnızca, aşağıdaki komutu çalıştırdığınızda yeni düğümleri görebilmelisiniz:

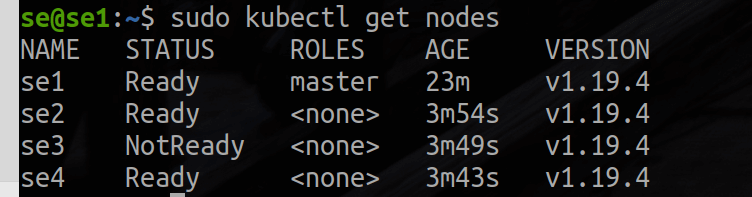

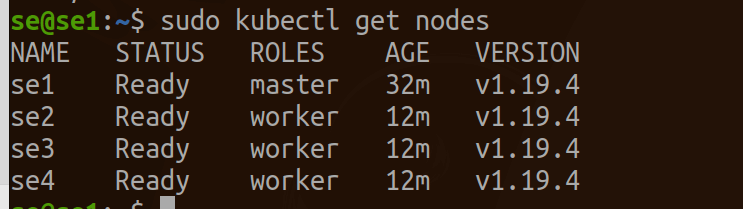

kubectl get nodesİşte üç worker düğümü için örnek bir çıktı.

Düğümlerinizi takip etmek için, her worker düğümünü bir worker olarak etiketleyin; bu, sahip olduğunuz modül sayısına göre aşağıdaki komutları çalıştırmakla ilgilidir! Bu örnek üç worker kullandığı için, şunları çalıştıracağız:

kubectl label node se2 node-role.kubernetes.io/worker=worker

kubectl label node se3 node-role.kubernetes.io/worker=worker

kubectl label node se4 node-role.kubernetes.io/worker=worker

Artık Jetson Mate & Jetson Nano modüllerinizde çalışan kendi Kubernetes kümenizi kurdunuz! Buradan, kümeye veri analitiği veya makine öğrenimi iş yükleri çalıştırmak için bir Jupyter çalışma zamanı kullanmak gibi çeşitli şeyler yapabilirsiniz!

Bunu nasıl yapabileceğinizi daha fazla okumak için, Seeed Wiki Sayfası‘nı ziyaret ettiğinizden emin olun!

Özet & Daha Fazla Kaynak

Kenar GPU kümeleri oluşturmak için güvenilir ve test edilmiş bir seçenek arıyorsanız, NVIDIA Jetson kümesini Jetson Mate Kümesi ile kullanmanızı şiddetle tavsiye ederim. Endüstri lideri destek ve yazılım uyumluluğu ile desteklenen kapsamlı bir donanım çözümü olarak, kenar bilişim uygulamanız için daha iyi bir çözüm bulmakta zorlanacaksınız!

Kümeleme veya kenar bilişim hakkında daha fazla bilgi edinmek ister misiniz? Aşağıdaki kaynakları deneyin:

“`