Geri alma artırımlı üretim (RAG) teknolojisi, geri alma ve üretim modellerinin yeteneklerini Büyük Dil Modelleri (LLM’ler) ile entegre ederek, sürekli gelişen taleplere karşı uyum sağlama ve yanıt verme yeteneklerini artırır. Bu yenilikçi yaklaşım, LLM’nin dinamik olarak yerel bir bilgi kütüphanesine erişerek ilgili ve güncel yanıtlar almasını sağlar, böylece yeni zorluklarla başa çıkmada daha çevik ve etkili hale gelir. RAG kullanımı, yanıt kalitesini artırmakla kalmaz, aynı zamanda LLM’lerden elde edilen değeri maksimize eder, çeşitli iş uygulamaları arasında daha akıllı ve bağlama duyarlı etkileşimleri kolaylaştırarak, işletmelerin dil işleme yeteneklerini daha büyük başarılar için nasıl kullandıklarında önemli bir değişim vaat eder.

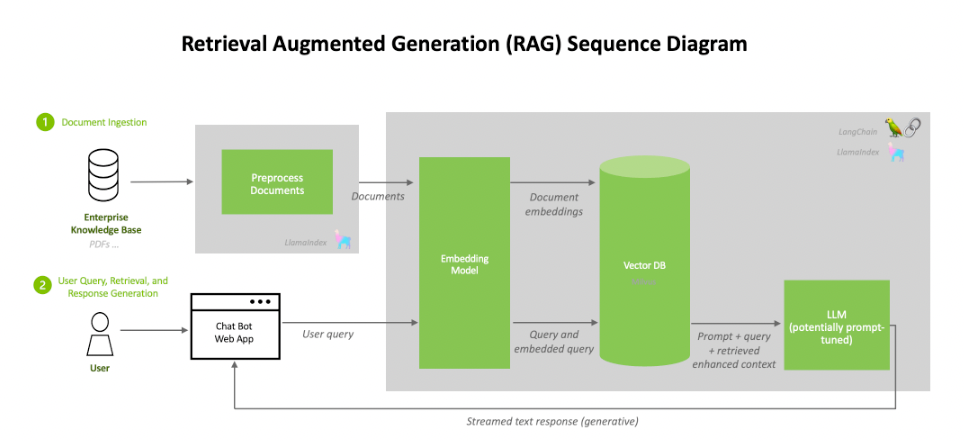

RAG Nasıl Çalışır?

2020 yılında Facebook AI Research tarafından tanıtılan RAG, dinamik, alan spesifik verileri kullanarak LLM’nin çıktısını optimize etmek için tasarlanmıştır ve yeniden eğitim gerektirmez. RAG, bir bilgi geri alma bileşenini bir yanıt üretici ile entegre eden uçtan uca bir mimariye sahiptir, bu sayede model, yanıtlarını geliştirmek için gerçek zamanlı olarak ilgili bilgileri erişip dahil edebilir.

RAG Pipeline Genel Görünümü

- Gömme Verisi: Uzmanlaşmış bir model, görüntüler, metin, ses ve video gibi çeşitli veri türlerini işler ve bunları vektörlere dönüştürür. Bu vektörler daha sonra bir vektör veritabanında saklanır.

- Girdi İşleme: Girdi metin veya görüntü olsun, aynı gömme işlemine tabi tutulur ve bir vektöre dönüştürülür.

- Vektör Eşleştirme: Sistem, girdi vektörüne en benzer en üst K vektörü tanımlamak için vektör veritabanını arar.

- Bağlamsal Yanıt Üretimi: Bu en üst vektörlerle bağlantılı belgeler, bir dil modeli için bağlam olarak hizmet eder ve bu bağlamdan bilgilendirilen yanıtlar oluşturur.

RAG Size Ne Getirebilir?

Neredeyse her işletme artık işlerine ilgili büyük veri setlerini yönetmektedir; bu veri setleri, teknoloji şirketlerindeki ürün kılavuzlarından, hukuk firmalarındaki dava verilerine ve hastanelerdeki hasta kayıtlarına kadar uzanmaktadır. Bu veri setleri büyüdükçe, en bilgili çalışanların bile her detayı hatırlaması pratik olmaktan çıkar ve bu genellikle müşteri etkileşimleri veya iç sorgular sırasında zaman alıcı veri aramalarına yol açar.

LLM kullanmak, çalışanların ve müşterilerin doğrudan sorgu yapmasına ve anında yanıt almasına olanak tanıyarak bu süreci kolaylaştırabilir. Ancak, LLM bazen ikna edici ama yanlış yanıtlar üretebilir; bu duruma halüsinasyon denir. RAG, LLM’yi güncellenmiş, doğru verilerle besleyerek bu durumu hafifletmeye yardımcı olur ve yanıtların güvenilirliğini ve bağlamsallığını artırır. RAG ve LLM entegrasyonu, yalnızca iş akışı verimliliğini artırmakla kalmaz, aynı zamanda sağlanan bilgilerin hem kesin hem de en güncel olmasını sağlayarak müşteri deneyimini de yükseltir.

Neden Yerel RAG’e İhtiyacınız Var?

RAG’nin, şirketlerden ve devlet kurumlarından gelen büyük miktarda veriyi etkili bir şekilde yönetmede kritik bir rol oynadığını biliyoruz; ancak, bu varlıklar tarafından saklanan verilerin genellikle gizli olması ve dış erişime kapalı olması beklenir. Bulut tabanlı LLM ve vektör veritabanlarının kullanılması, veri sızıntısı riski oluşturabilir. Bunu önlemek için, vektör veritabanı ve LLM’nin yerinde uygulanması gereklidir.

Vektör veritabanı ve büyük dil modelini yerinde kurarak, hassas verileri dış tehditlerden etkili bir şekilde koruruz ve ayrıca verilerin uzaktan işlenmesi sırasında bant genişliği ve ağ kısıtlamaları nedeniyle meydana gelen gecikme sorunlarını önemli ölçüde azaltırız; yerel işleme, bilgilere hızlı ve güvenli bir şekilde erişim sağlar. Kısacası, yerel RAG kullanmak yalnızca verileri korumakla kalmaz, aynı zamanda dil modeli işlemenin yanıt verme hızını optimize eder ve hassas ve geniş veri setlerini yönetmek için sağlam bir çözüm sunar.

Jetson Orin ile Yerel RAG’i Deneyimleyin

Yerel bir sohbet botu ile bağlam araması:

İşte MLC teknolojisi ile optimize edilmiş Llama2-7b modelini içeren demo. Bu yaklaşım, yüksek doğruluğu korurken veri işleme hızlarını artırır. Hızlı geri alma ve ölçeklenebilir depolama çözümleri sağlamak için ChromaDB, yüksek performanslı bir vektör veritabanı kullanıyoruz ve veri senkronizasyonu ve indeksleme için Llama_Index ile tamamen entegre ediyoruz. Tüm sistem, olağanüstü hesaplama gücü ve enerji verimliliği sunan reComputer J4012 tarafından desteklenmektedir; bu, gerçek zamanlı AI uygulamaları için idealdir. Teknoloji yelpazemiz hakkında daha derinlemesine bilgi almak ve dağıtım için gerekli araçlara erişmek için kapsamlı GitHub deposumuzu ziyaret edin.

Veritabanı üzerinden görüntü araması:

NVIDIA Jetson AI Lab‘dan sergilenen demo ile tanışın; bu, tek seferde sınıflandırma ve tanıma için en son multimodal RAG’yi göstermektedir. Bu güçlü sistem, gerçek zamanlı işleme için CLIP ile dinamik Görüntü ve Dil Modellerini (VLM) bir arada kullanır. Çalışma zamanında VectorDB’de saklanan görüntü meta verilerini analiz ederek içeriği etkili bir şekilde etiketler ve tanır. Bu sofistike entegrasyon, gelişmiş AI’nın multimodal verileri sorunsuz bir şekilde işleme ve yorumlama potansiyelini sergilemektedir.

Hızlı yanıt ve bildirim:

Bu demo, gelişmiş multimodal RAG ve VILA (ön eğitimli VLM) ile sorunsuz entegrasyonu içeren canlı Llava ve web arayüzünün geliştirilmiş yeteneklerini vurgulamaktadır. Sistem, olay filtreleme ve eylem ile uyarılar için yapılandırılabilir tetikleyiciler sunarak kullanıcıların görüntü sorgularını dinamik olarak ayarlamalarına, akıllı kameralar geliştirmelerine ve uyarı veya eylem mekanizmalarını daha da kişiselleştirmek için özel kod eklemelerine olanak tanır.

Seeed NVIDIA Jetson Ekosistemi

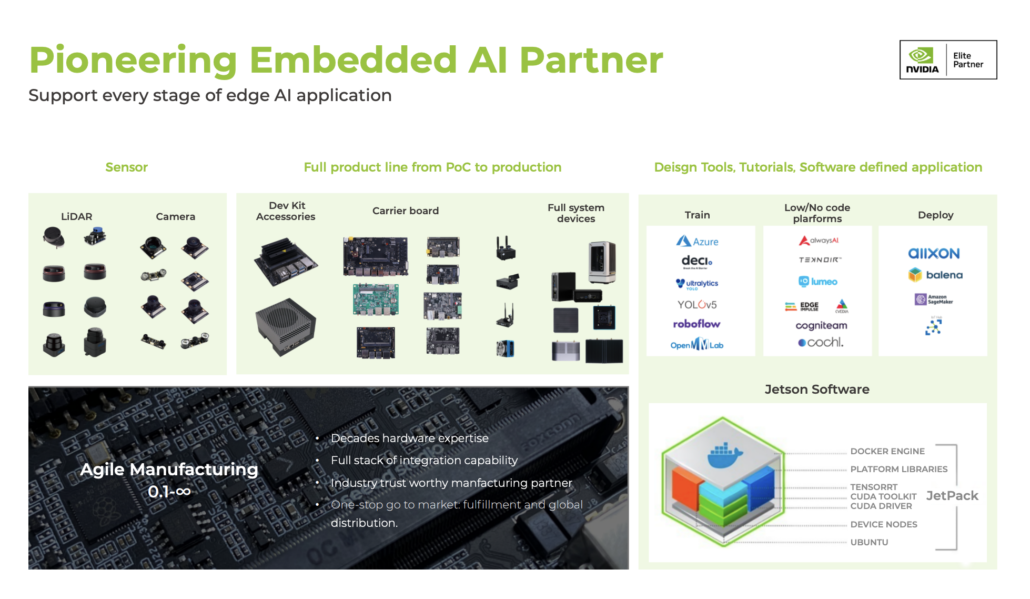

Seeed, NVIDIA Partner Network‘de kenar AI için bir Elite ortaktır. Daha fazla taşıyıcı kart, tam sistem cihazları, özelleştirme hizmetleri, kullanım durumları ve geliştirici araçları için Seeed’in NVIDIA Jetson ekosistemi sayfasını keşfedin.

“`html

Yenilikçi AI öncüsü olmaya katılın! Endüstrilerde makine öğreniminin gerçek dünyada uygulanmasını devrim niteliğinde değiştirmek için en son donanım ve teknolojinin gücünden yararlanın. Geliştiricilere ve işletmelere mevcut en iyi ML çözümlerini sağlama misyonumuzun bir parçası olun. Daha fazla edge AI olasılıklarını keşfetmek için başarılı vaka çalışması kataloğumuzu gözden geçirin!

Sonsuz bilgisayarla görme uygulama olasılıklarını keşfedin görüş AI kaynak merkezi aracılığıyla!

İlk adımı atın ve bu heyecan verici yolculuğun bir parçası olmak için bize bir e-posta gönderin edgeai@seeed.cc !

Size uygun bir seçenek bulmak için en son Jetson Kataloğumuzu indirin. İhtiyaçlarınıza uygun hazır Jetson donanım çözümünü bulamazsanız, lütfen özelleştirme hizmetlerimizi kontrol edin ve değerlendirme için bize yeni bir ürün sorgusu gönderin odm@seeed.cc adresine.

“`